هوش مصنوعی چه خطراتی برای ما خواهد داشت

آرِند هینتز، استادیار زیستشناسی یکپارچه و علوم کامپیوتر و مهندس از دانشگاه ایالتی میشیگان، بهعنوان یک توسعهدهندهی هوش مصنوعی به آسیبشناسی این ماشینها میپردازد و به ترسهایی که در مورد آنها وجود دارد، پاسخ میدهد:

بهعنوان یک محقق حوزهی هوش مصنوعی گاهی با این ایده روبهرو میشوم که اکثر مردم ازآنچه ممکن است هوش مصنوعی به آن تبدیل شود، هراس دارند. شاید این مسئله تعجبآور نباشد؛ این ترس به دلیل نگاهی است که تاریخ و صنعت سینما به ما دادهاند؛ نگاهی که به ما ترس از سلطهی سایبرنتیک را القا میکند و همانطور که در فیلم ماتریکس دیدهاید، به ما هشدار میدهد که نیروهایی خواهند آمد و ما را بهعنوان باتریهای انسانی در محفظههایی زندانی میکنند. برای من که بهعنوان توسعهدهندهی هوش مصنوعی از مدلهای کامپیوتری برای تکامل آن استفاده میکنم، فکر کردن به این موضوع که در آینده این موجودات بیگناه مجازی به هیولاهایی تبدیل خواهند شد، دشوار است. آیا ممکن است من بهعنوان ویرانگر دنیا شناخته شوم؛ همانطور که اوپِنهایمِر بعد از رهبری کردن ساخت اولین بمب اتمی، به سرزنش خود پرداخت؟

با این کار من معروف خواهم شد اما شاید حق با منتقدان باشد. شاید من نباید از این سؤال دوری کنم که بهعنوان یک متخصص هوش مصنوعی، کدام جنبه از آن برای من هراسانگیز است؟

ترس از اتفاقات پیشبینی نشده

کامپیوتر اچاِیاِل ۹۰۰۰ که آرتور سی.کلارک، نویسندهی داستان علمی تخیلی، در رؤیای خود داشت و اِستَنلی کوبریک، کارگردان فیلم ۲۰۰۱: یک ادیسهی فضایی، به زندگی ما آورد، مثال خوبی است از سیستمی که به دلیل پیامدهای ناخواسته، شکست خورد.

در اکثر سیستمهای پیچیده مانند کشتی تایتانیک، شاتل فضایی ناسا، نیروگاه هستهای چرنوبیل مهندسان لایههای بسیاری از اجزای مختلف را با یکدیگر ترکیب میکنند. طراحان ممکن است بهخوبی این موضوع را بدانند که هر جزء بهتنهایی چگونه کار میکند؛ اما گاهی از این موضوع که قطعات در ارتباط با یکدیگر چگونه کار میکنند، آگاهی کافی ندارند؛ نتیجهی این آگاهی کم، سیستمی است که هرگز بهطور کامل درک نمیشود و ممکن است در راههای پیشبینینشده شکست بخورد؛ در هر فاجعهای نظیر غرق شدن یک کشتی، انفجار دو شاتل فضایی و گسترش آلودگیهای رادیواکتیو در اروپا و آسیا، اشتباهات کوچک با هم ترکیب میشوند و یک فاجعه را به وجود میآورند.

در تحقیقات هوش مصنوعی نیز ممکن است چنین اشتباهاتی رخ دهد. ما به آخرین دستاوردهای علوم شناختی و ادراکی نگاهی میاندازیم، آنها را به الگوریتم تبدیل میکنیم و به سیستمهای موجود میافزاییم؛ در این راه ما مهندسان تلاش میکنیم بدون آنکه در قدم اول هوش یا شناخت را درک کنیم، هوش مصنوعی را بسازیم.

سیستمهایی مانند واتسون آیبیام و آلفای گوگل به شبکههای عصبی مصنوعی و حجم عظیمی از توان پردازشی تجهیز شدهاند و شاهکارهای چشمگیری انجام دادهاند؛ اما اگر این ماشینها اشتباهی مرتکب شوند دیگر نمیتوانند استاد بازی گو را شکست دهند یا در بازی جِپِردی شکست میخورند. عواقب این اشتباهات دنیا را تغییر نمیدهد؛ درواقع بدترین اتفاقی که ممکن است رخ دهد این است که فردی مقداری از پولی را که روی موفقیت هوش مصنوعی شرطبندی کرده است، از دست بدهد؛ اما چون طراحی هوش مصنوعی در حال پیچیدهتر شدن است و پردازندههای کامپیوتر نیز سریعتر شدهاند، مهارت این سیستمها افزایش مییابد. این امر باعث میشود حتی اگر خطر پیامدهای ناخواسته افزایش یابد، مسئولیتهای بیشتری به این سیستمها بدهیم؛ و ازآنجاییکه انسان جایزالخطا است، به نظر میرسد که به وجود آوردن سیستمی کاملاً ایمن غیر ممکن باشد.

ترس از سوءاستفاده

ازنظر من عواقب ناخواسته در گونههای مختلف هوش مصنوعی که با استفاده از روشی بانام نورو اوولوشن درحالتوسعهی آنها هستم، زیاد نگرانکننده نیست. من محیطی مجازی خلق میکنم و موجودات دیجیتال را با ذهنی که برای انجام وظایف پیچیده آموزش میبیند، تکامل میدهم. عملکرد این مخلوقات مورد ارزیابی قرار میگیرد و آنهایی که بهترین عملکرد را دارند برای تولید مجدد انتخاب میشوند و نسل بعدی هوش مصنوعی را میسازند؛ بعد از تولید چندین نسل، این مخلوقات ماشینی تکامل پیدا میکنند و تواناییهای ادراکی کسب میکنند.

همینالان ما در حال برداشتن قدمهایی کوچک برای تکامل این ماشینها هستیم؛ تکاملی که باعث میشود هوش مصنوعی بتواند وظایف ناوبری ساده را انجام دهد، تصمیماتی ساده بگیرد یا چند بایتی را به خاطر بیاورد؛ اما بهزودی ما ماشینهایی تکامل خواهیم داد که میتوانند وظایف پیچیدهتری را اجرا کنند و فهم عمومی بسیار بهتری داشته باشند. درنهایت ما امیدواریم که بتوانیم ماشینی همسطح با هوش انسانی ایجاد کنیم.

در طول این مسیر و در روند تکامل هوش مصنوعی، ما ارورها و مشکلات را پیدا خواهیم کرد و آنها را حذف میکنیم. در هر نسل، ماشینها بهتر میتوانند ارورهای ایجادشده در نسل قبلی را برطرف کنند؛ این کار باعث میشود شانس پیدا کردن پیامدهای ناخواسته در شبیهسازیها افزایش یابد و بتوانیم قبل از آنکه این مشکلات وارد دنیای واقعی شوند، آنها را حذف کنیم.

مورد دیگری که احتمال آن کمتر است، استفاده از این سیر تکاملی برای تأثیر گذاشتن بر اخلاق سیستمهای هوش مصنوعی است. این فرایند همانند صفات اخلاقی در انسانها است؛ صفاتی مانند امانتداری و نوعدوستی که درنتیجهی سیرتکاملی انسانها به وجود آمدهاند و بهعنوان فاکتورهایی برای ادامهی زندگی در نظر گرفته میشوند.

ما میتوانیم محیطهای خود را بهصورت مجازی برای ایجاد برتری تکاملی در ماشینها بهگونهای تنظیم کنیم تا صفاتی مانند محبت، صداقت و یکدلی را به آنها نشان دهیم؛ این ممکن است راهی باشد تا خدمتکارانی فرمانپذیرتر یا همراهانی قابل اعتماد توسعه دهیم و رباتهای قاتل و بیرحم کمتری به وجود آوریم.

باوجوداینکه نورو اوولوشن این امکان را دارد که احتمال بهوجود آمدن پیامدهای ناخواسته را کاهش دهد؛ اما نمیتواند مانع سوءاستفاده از هوش مصنوعی شود؛ بااینوجود این مسئله یک مشکل علمی نیست و مشکلی اخلاقی است؛ بهعنوان یک دانشمند، من متعهد هستم تا بهدرستی یافتههای حاصل از آزمایشهایم را گزارش دهم؛ چه این نتایج موردپسند من باشند، چه نباشند. دوست داشتن یا موافقت برای من مورد توجه نیست، مهم این است که بتوانیم یافتههایمان را بازگو کنیم.

ترس از اولویتهای اشتباه اجتماعی

دانشمند بودن من را از انسان بودن مبرا نمیکند و من باید در پارهای از موارد با آرزوها و ترسهایم مجددا ارتباط برقرار کنم. بهعنوان موجودی اخلاقی و سیاسی، من باید پیامدهای احتمالی کار خود و تأثیرات احتمالی آن بر جامعه را در نظر بگیرم. ما بهعنوان جامعهی محققان هنوز به یک ایدهی واضح در مورد هوش مصنوعی و چیزی که به آن تبدیل میشود نرسیدهایم؛ یکی از علتهای این مسئله این است که ما هنوز در مورد قابلیتهای هوش مصنوعی اطلاعی نداریم؛ اما نیاز داریم که در مورد نتایج مطلوب حاصل از هوش مصنوعی پیشرفته، تصمیم بگیریم.

یکی از مناطق بزرگی که تحت تأثیر هوش مصنوعی قرار دارد، فعالیتهای انسانی است؛ رباتها در حال حاضر کارهای فیزیکی مانند جوشکاری قسمتهای مختلف خودروها را انجام میدهند. در آیندهای نزدیک ممکن است آنها فعالیتهای ادراکی و شناختی را که تا به امروز تنها به انسانها اختصاص داشته است، انجام دهند؛ خودروهای خودران میتوانند جایگزین رانندههای تاکسی شوند؛ هواپیماهای خودپرواز میتوانند جایگزین خلبانها شوند. بهجای کمکهای گروه پزشکی در اورژانس، بیماران میتوانند توسط یک سیستم متخصص مورد معاینه قرار گیرند و با دسترسی فوری به پایگاه اطلاعات پزشکی که تا به آن روز جمعآوری شده است، نوع بیماری آنها تشخیص داده شود و جراحیهای بهوسیلهی رباتی خستگیناپذیر و با دستانی کاملا بدون لرزش انجام شود.

مشاورهی حقوقی میتواند از پایگاه دادههای حقوقی به دست آید؛ مشاورهی مالی و سرمایهگذاری نیز میتواند از سیستم پیشبینی بازار به دست آید. شاید روزی فرارسد که تمام شغلهای انسانی بهوسیلهی ماشینها انجام شوند؛ حتی کار توسعهی هوش مصنوعی که من به آن مشغول هستم بهوسیلهی تعداد زیادی از ماشینهای خستگیناپذیر در تحقیقات هوش مصنوعی، سریعتر انجام شود.

در جامعهی امروزی ما، اتوماسیون انسانها را از کار برکنار کرده است و صاحبان ماشینها را پولدارتر و دیگر افراد را فقیرتر کرده است. این مشکل یک مسئلهی علمی نیست و باید از نقطهنظر سیاسی و اجتماعی و اقتصادی حل شود. تحقیقات و سیاستهای یک توسعهدهنده نمیتواند این موارد را تغییر دهد؛ اما با همکاری همه، میتوانیم شرایطی ایجاد کنیم که در آن هوش مصنوعی بهجای ایجاد فاصله بین افراد پولدار و ضعیف، برای همه سودمند باشد.

ترس از سناریوهای کابوس مانند

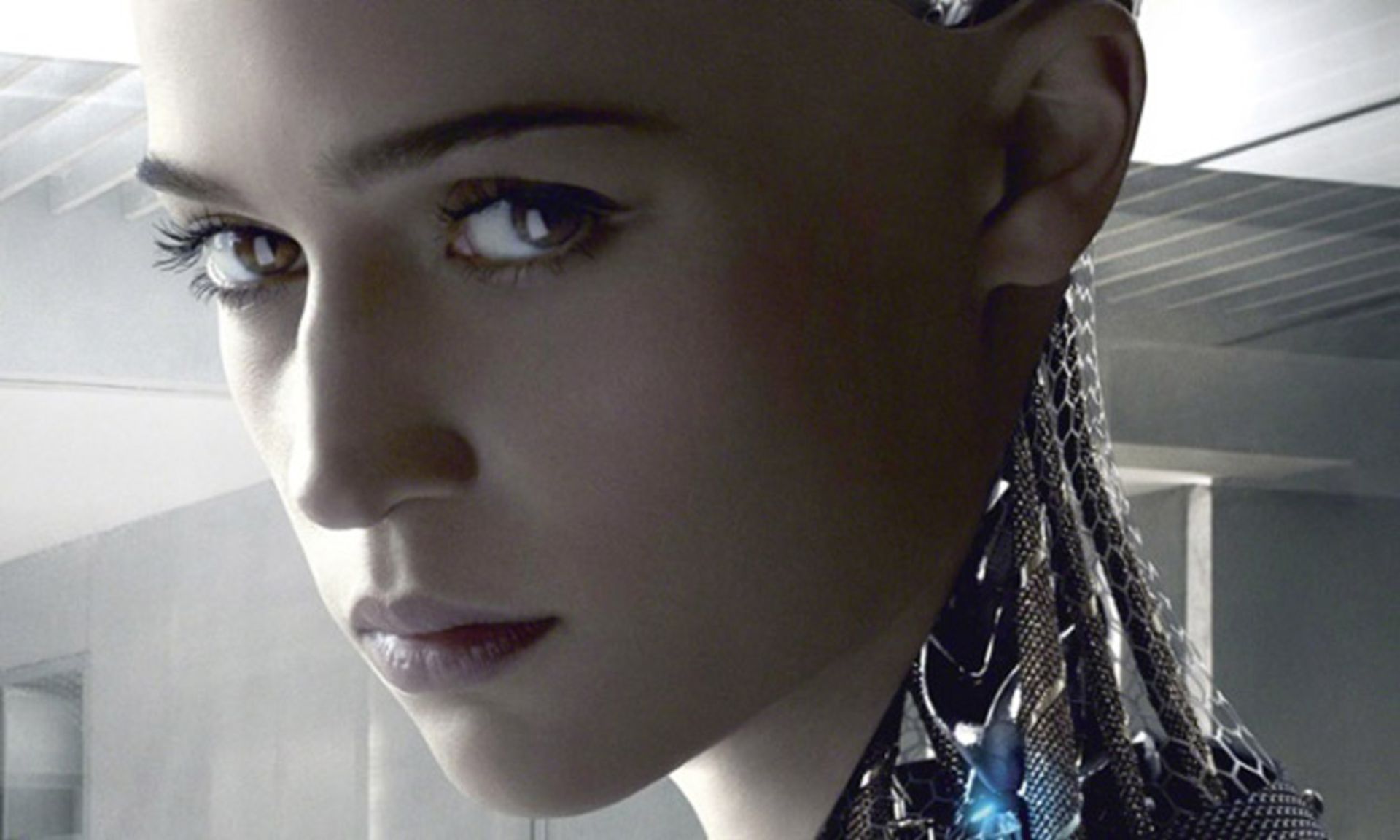

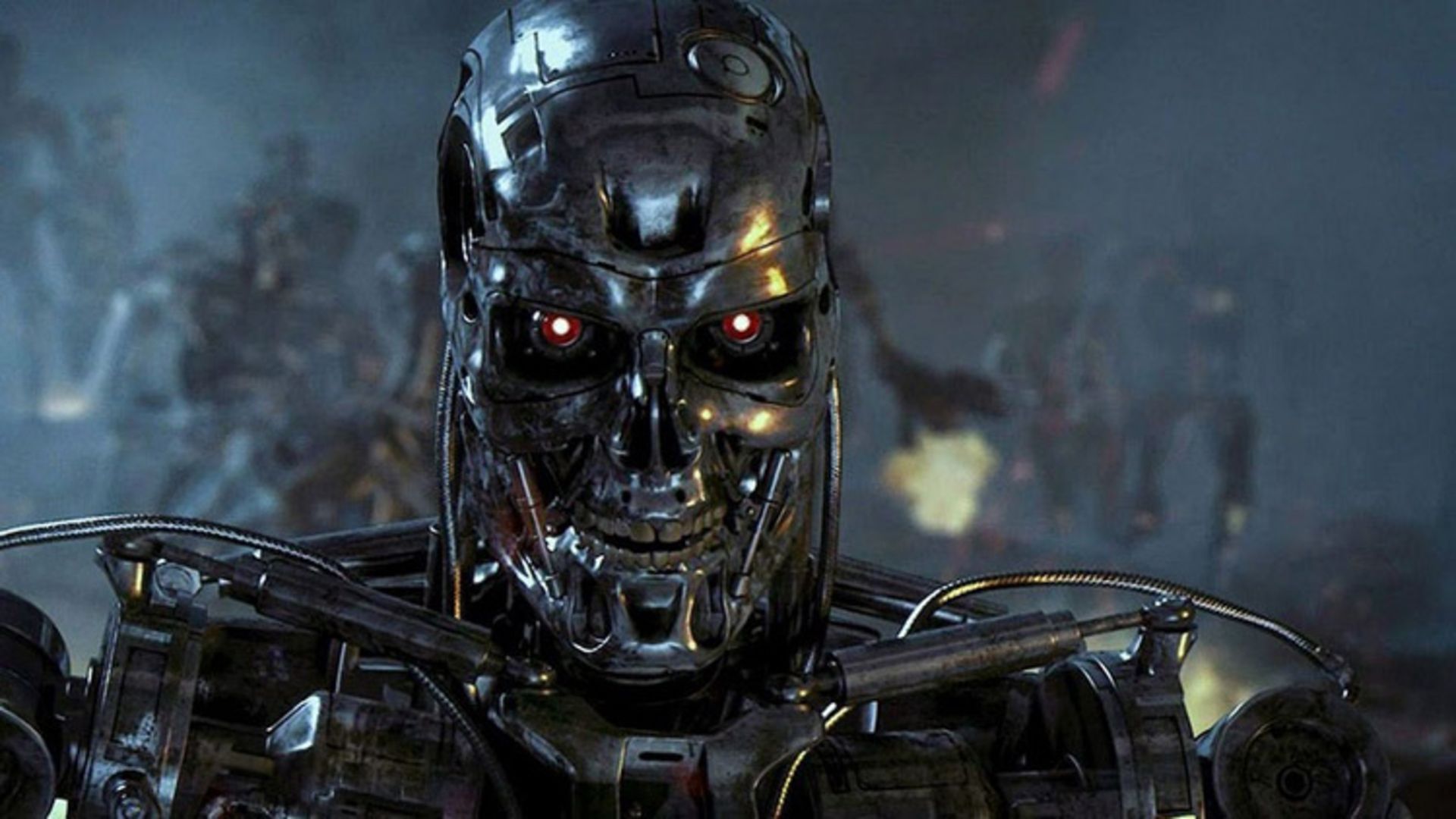

با مجسم کردن اچاِیاِل ۹۰۰۰، ترمیناتور یا هر داستان تخیلی دیگری که هوش مصنوعی فرابشری دارند، این سؤال به وجود میآید که اگر هوش مصنوعی به پیشرفت خود ادامه دهد و به سطحی فراتر از هوش انسانی برسد، آیا این سیستمهای فوقالعاده هوشمند یا حداقل یکی از آنها، به این نتیجه میرسد که دیگر به انسانها نیازی نیست؟ ما انسانها چگونه وجود خودمان را در نظر این هوشهای فرابشری که کارهایی فراتر از تواناییهای انسان انجام میدهند، توجیه میکنیم؟ آیا ما میتوانیم مانع از انقراض خود بهوسیلهی ماشینهایی شویم که زمانی برای کمک به ما خلق شدهاند؟ سؤال کلیدی در این سناریو این است: چرا باید یک هوش فرابشری انسانها را زنده نگه دارد؟

من ممکن است دربارهی خودم با این هوش فرابشری گفتوگو کنم و به او بگویم فرد خوبی هستم که ممکن است کمک کرده باشد تا هوش مصنوعی به این مرحله برسد. همچنین ممکن است که التماس کنم که هوش فرابشری من را بهعنوان شخصی بامحبت و دلسوز زنده نگه دارد. من میتوانم دربارهی ارزشمند بودن تنوع با این هوش فرابشری گفتوگو کنم و به او بگویم وجود بشریت با وجود داشتن جهانی بسیار بزرگ، ممکن است اصلا اهمیتی نداشته باشد؛ اما من به نمایندگی از تمام بشریت صحبت نمیکنم و آوردن استدلالی قانعکننده برای ادامهی حیات تمام انسانها کار دشواری است.

وقتی که با نگاهی دقیقتر به خودمان مینگریم، اشتباهات بسیاری میبینم: ما انسانها از هم متنفریم، با یکدیگر میجنگیم، دانش، غذا یا کمکهای پزشکی را بهطور عادلانه توزیع نمیکنیم و سیارهی خود را آلوده میکنیم. موارد خوب بسیاری نیز در دنیا وجود دارد؛ اما تمام بدیهای ما باعث ضعف در گفتمان و درخواست ادامهی حیات از هوش فرابشری میشود.

خوشبختانه، در حال حاضر احتیاجی نداریم که وجود خودمان را برای این ماشینها توجیه کنیم. ما مدتزمانی بین ۵۰ تا ۲۵۰ سال وقت داریم که البته این فرصت زمانی بهسرعت توسعهی هوش مصنوعی نیز بستگی دارد و در این مدت میتوانیم بهعنوان گونهای از حیات گرد هم بیاییم و برای این سؤال که چرا هوش فرابشری نباید ما را از صحنهی حیات پاک کند، جوابی قانعکننده پیدا کنیم.

هر کدام از ما چه بهصورت انفرادی و چه در قالب جامعه، باید خود را برای این سناریوهای کابوس مانند آماده کنیم و با استفاده از زمانی که برایمان باقی مانده است دلیلی برای ادامهی حیاتمان پیدا کنیم؛ اما راه دیگر این است که به این باور برسیم که این اتفاق هرگز نخواهد افتاد تا دیگر نگران این مسئله نباشیم.

اما بدون در نظر گرفتن تهدیدات فیزیکی که هوش فرابشری ممکن است داشته باشد، این ماشینها میتوانند تهدیدهایی سیاسی و اقتصادی برای ما باشند. اگر ما راهی برای توزیع ثروت بین تمام انسانها پیدا نکنیم، نظامی سرمایهداری پدید میآوریم که در آن هوش مصنوعی تنها در خدمت کسانی است که تمام ابزارهای تولید را در اختیار دارند.