آیا هوش مصنوعی میتواند به ما کمک کند تا با حیوانات حرف بزنیم؟

یک مربی دلفین با دستهایش علامت «باهم» و سپس «ایجاد کنید» را نشان میدهد. دو دلفین آموزشدیده زیر آب ناپدید میشوند، صداهایی را ردوبدل میکنند و سپس ظاهر میشوند و حرکت خاصی را انجام میدهند. آنها ترفند جدیدی را اختراع کردهاند و همانطور که از آنها خواسته شده است، آن را پشت سر هم اجرا میکنند. آزا راسکین، میگوید: «این ثابت نمیکند که زبانی وجود دارد؛ اما منطقی است که اگر به روش ارتباطی غنی و نمادینی دسترسی داشته باشند، انجام این کار بسیار راحتتر میشود.»

راسکین یکی از بنیانگذاران و رئیس پروژه گونههای زمین (ESP) است. این گروه غیرانتفاعی هدف بلندپروازانهای دارد: رمزگشایی از ارتباطات غیرانسانی با استفاده از شکلی از هوش مصنوعی که یادگیری ماشین نامیده میشود و انتشار عمومی دادهها بهطوریکه با همکاری پژوهشگران دیگر ارتباط ما با گونههای دیگر عمیقتر شود و به محافظت از آنها کمک کند. آلبوم موسیقی «آوازهای نهنگ گوژپشت» در سال ۱۹۷۰ موجب ایجاد جنبشی شد که ممنوعیت صید نهنگها را در پی داشت. حال تصور کنید، ابزاری که برای سلسله جانوران مانند مترجم گوگل عمل میکند، چه چیزهایی میتواند به ارمغان بیاورد؟

پروژه گونههای زمین که سال ۲۰۱۷ به کمک اهداکنندگانی مانند رید هافمن، همبنیانگذار لینکدین راهاندازی شد، دسامبر گذشته اولین مقاله علمی خود را منتشر کرد. هدف سازمان مذکور این است که در طول زندگی ما بتواند ارتباطات حیوانات را رمزگشایی کند. راسکین میگوید: «هدف ما این است که بتوانیم ارتباطات حیوانی را رمزگشایی کنیم و زبان غیرانسانی را کشف کنیم. در طول این مسیر فناوریهایی توسعه پیدا خواهد کرد که از زیستشناسان و حفاظت پشتیابی خواهد کرد.»

درک صداهای جانوران مدتها موردتوجه انسانها بوده است. نخستیسانان مختلف صداهای هشداری را تولید میکنند که برحسب شکارچی میتواند متفاوت باشد؛ دلفینها یکدیگر را با صداهای سوت خاصی مورد خطاب قرار میدهند و برخی از پرندگان آوازخوان میتوانند عناصری از صداهای خود را بردارند و ترتیب آنها را عوض کنند تا پیامهای متفاوتی به هم منتقل کنند؛ اما بیشتر کارشناسان از اینکه این موارد را زبان بنامند، خودداری میکنند؛ زیرا هیچیک از ارتباطات حیوانی تمام معیارهای زبان را ندارند.

تا این اواخر، رمزگشایی ارتباطات حیوانات بیشتر روی مشاهداتی متکی بود که بهسختی به دست میآمد؛ اما علاقه پژوهشگران به استفاده از یادگیری ماشین برای کارکردن با حجم عظیمی از دادهها که اکنون میتواند به کمک حسگرهای متصل به حیوانات، جمعآوری شود، افزایش پیدا کرده است.

الودی بریفر، دانشیار دانشگاه کپنهاگ که ارتباطات آوایی را در پستانداران و پرندگان مطالعه میکند، میگوید، برخی از پژوهشگران این حوزه شروع به استفاده از یادگیری ماشین کردهاند؛ اما هنوز نمیدانیم که تا چه حد میتواند به ما کمک کند.

بریفر و همکارانش الگوریتمی را توسعه دادهاند که صدای خوکها را تجزیهوتحلیل میکند تا بگوید که آیا حیوان احساسات مثبت یا منفی را تجربه میکند. اوایل سال جاری، بریفر و همکارانش مطالعهای درباره احساسات خوکها براساس صداهای آنها منتشر کردند. ۷۴۱۴ صدا از ۴۱۱ خوک در شرایط مختلف جمعآوری شده بود.

الگوریتم دیگری به نام DeepSqueak براساس صداهای التراسونیک (مافوق صوت) جوندگان قضاوت میکند که آیا تحت استرس قرار دارند. ابتکار دیگری به نام Project CETI قصد دارد از یادگیری ماشین برای ترجمه ارتباطات نهنگهای عنبر استفاده کند. اگرچه ESP میگوید رویکرد متفاوتی دارد؛ زیرا روی رمزگشایی از ارتباطات یک گونه متمرکز نیست، بلکه همه گونهها را هدف قرار میدهد.

درحالیکه راسکین اذعان میکند احتمال وجود ارتباطات نمادین غنی در حیوانات اجتماعی بیشتر است (برای مثال نخستیسانان، نهنگها و دلفینها)، هدف آنها توسعه ابزارهایی است که بتواند در کل سلسله جانوران استفاده شود. راسکین میگوید: «مدل ما مستقل از گونه عمل میکند. ابزارهایی که ما توسعه میدهیم، میتواند در تمام زیستشناسی از کرمها گرفته تا نهنگها کار کند.»

راسکین میگوید مطالعهای که نشان داده است یادگیری ماشین را میتوان بدون نیاز به دانش قبلی برای ترجمه زبانهای مختلف و گاها زبانهای دور انسانی به کار برد، انگیزهبخش انجام پروژه جدید بوده است.

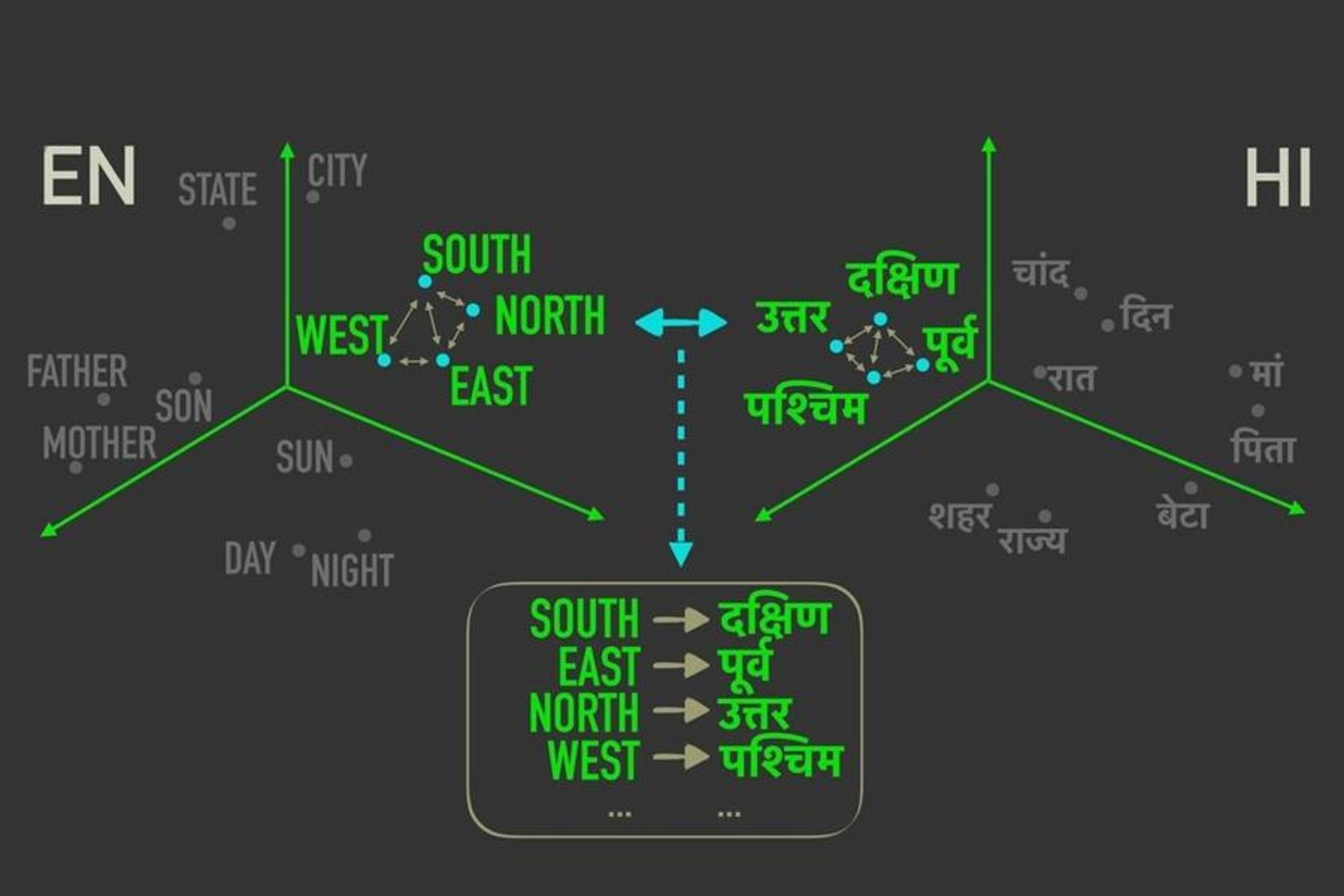

فرایند مذکور با توسعه الگوریتمی برای نمایش کلمات در فضایی فیزیکی شروع میشود. در این نمایش هندسی چندبعدی، فاصله و جهت بین نقاط (کلمات) نشان میدهد که آنها ازنظر معنا چقدر با هم ارتباط دارند. برای مثال، واژه «شاه» با واژه «مرد» دارای ارتباطی با همان فاصله و جهت است که واژه «زن» با واژه «ملکه» دارد. (نقشهبرداری با دانستن معنای کلمات انجام نمیشود، بلکه برای مثال با نگاهکردن به تعداد دفعاتی که واژههای موردنظر در کنار هم ظاهر میشوند، انجام میشود).

بررسی پژوهشگران نشان داد که این اشکال برای زبانهای مختلف مشابه است. سپس در سال ۲۰۱۷، دو گروه از پژوهشگران که بهطور مستقل کار میکردند، روشی را پیدا کردند که کنار هم قرار دادن اشکال مشابه، امکان دستیابی به ترجمه را ممکن میساخت. برای رسیدن از انگلیسی به اردو، شکلهای آنها را با هم مطابقت دهید و نقطهای را در اردو پیدا کنید که به نقطه واژه در انگلیسی نزدیکتر است. راسکین میگوید به این روش میتوانید بیشتر کلمات را به خوبی ترجمه کنید.

هدف ESP این است که این نوع بازنماییها از ارتباطات حیوانی را ایجاد کند (با کار روی گونههای فردی و هم چند گونه به صورت همزمان) و سپس به بررسی سوالاتی مانند این مورد بپردازد که آیا اشکال ارتباطی حیوانی با اشکال انسانی همپوشانی دارد. راسکین میگوید نمیدانیم که حیوانات چگونه جهان را تجربه میکنند؛ اما بهنظر میرسد احساساتی مانند غم و شادی در آنها نیز وجود داشته باشد و ممکن است آن را با دیگر اعضای گونه خود به اشتراک بگذارند.

دلفینها از صداهای مختلفی برای ارتباط برقرارکردن با هم استفاده میکنند؛ اما آنها چه میگویند؟

راسکین اضافه میکند، حیوانات فقط به شکل صوتی با هم ارتباط برقرار نمیکنند. برای مثال، زنبورها به کمک حرکاتی که رقص نامیده میشود، درمورد مکان گلها به هم خبر میدهند. بنابراین، لازم است روشهای مختلف ارتباطی را نیز بتوانیم ترجمه کنیم. راسکین تصدیق میکند که این هدف چیزی شبیه رفتن به ماه است؛ اما قرار نیست که یکباره به هدف برسیم. درعوض، برنامه کاری ESP شامل حل مسائل کوچکتر برای رسیدن به تصویری بزرگتر است. این کار باید با توسعه ابزارهای عمومی همراه باشد که بتواند به پژوهشگران کمک کند تا از هوش مصنوعی برای رمزگشایی اسرار کل گونههای مورد مطالعه استفاده کنند.

برای مثال، ESP اخیراً مقالهای را درمورد «مشکل مهمانی شبانه» در ارتباطات حیوانات منتشر کرده است که در آن در محیطی پرسروصدا تشخیص اینکه کدامیک از حیوانات یک گروه درحال ایجاد صدا است، دشوار است. مدل هوش مصنوعی توسعهیافته توسط ESP روی صدای دلفینها، ماکاکها و خفاشها آزمایش شده است و زمانی که صداها به افرادی تعلق داشتند که مدل براساس آنها آموزش دیده بود، بهترین عملکرد را داشت؛ اما با مجموعه داده بزرگتر میتوانست مخلوطی از صداهای حیواناتی را که در گروه آموزش حضور نداشتند، تفکیک کند.

پروژه دیگر شامل استفاده از هوش مصنوعی برای تولید صداهای جدید است. در این پروژه ابتدا نهنگ گوژپشت مورد آزمایش قرار میگیرد. صداهای جدید که با تفکیک صداها به اجزای کوچکتر و استفاده از مدل زبانی برای ایجاد صداهایی شبیه صدای نهنگها ساخته میشوند، میتوانند برای حیوانات پخش شوند و واکنش آنها بررسی شود. راسکین توضیح میدهد اگر هوش مصنوعی بتواند تغییرات تصادفی را از تغییرات معنادار تمایز دهد، به ارتباطات معنادار نزدیکتر خواهیم شد.

کلاغهای هاوایی به دلیل استفاده از ابزار معروف هستند؛ اما همچنین این باور وجود دارد که دارای مجموعه پیچیدهای از صداها هستند.

هدف پروژه دیگری توسعه الگوریتمی است که با استفاده از یادگیری ماشین خودنظارتی که بهمنظور یادگیری الگوها، به برچسبگذاری دادهها توسط متخصصان انسانی نیازی ندارد، مشخص کند یک گونه جانوری چند نوع صدا دارد.

در آزمایش اولیهای، الگوریتم مذکور صداهای ضبطشده توسط گروهی از پژوهشگران به سرپرستی کریستین روتز، استاد زیستشناسی دانشگاه سنت اندروز را کاوش خواهد کرد تا فهرستی از مجموعه صداهای کلاغهای هاوایی را ایجاد کند. روتز کشف کرده است که این گونه کلاغ توانایی ساخت و استفاده از ابزار را برای پیداکردن غذا دارد. این باور وجود دارد که کلاغ هاوایی نسبتبه سایر گونههای کلاغ، مجموعه پیچیدهتری از صداها را دارد.

روتز خصوصا درمورد ارزش حفاظتی پروژه هیجانزده است. کلاغ هاوایی در بحران انقراض قرار دارد و فقط در اسارت وجود دارد. پژوهشگران درحال پرورش و تکثیر این گونه در اسارت هستند تا آن را به حیات وحش برگردانند.

پژوهشگران امیدوار هستند که با استفاده از صداهایی که در زمانهای مختلف ضبط شده است، بتوانند بررسی کنند که آیا خزانه آوایی این گونه در اسارت تحلیل رفته است (برای مثال آیا صداهای خاصی که برای هشدار دادن استفاده میشود، از بین رفته است). این امر میتواند پیامدهایی برای معرفی مجدد گونهها داشته باشد. روتز میگوید: «این موضوع میتواند تغییر چشمگیری در توانایی ما برای کمک به بازگشت این پرندگان از آستانه انقراض ایجاد کند.» البته او میگوید شناسایی و طبقهبندی دستی صداها کاری پرزحمت و مستعد خطا است.

در همین حین، پروژه دیگری بهدنبال درک خودکار معانی کاربردی صداها است. این پروژه در آزمایشگاه آری فریدلندر، استاد علوم اقیانوسی در دانشگاه کالیفرنیا در سانتا کروز دنبال میشود. آزمایشگاه فریدلندر نحوه رفتار پستانداران دریایی وحشی را که مشاهده مستقیم آنها دشوار است، در زیر آب مطالعه میکند و یکی از بزرگترین برنامههای برچسبگذاری در جهان را اجرا میکند. دستگاههای الکترونیکی کوچک متصل به حیوانات، موقعیت، نوع حرکت و حتی آنچه را که حیوانات میبینند، ثبت میکنند (دستگاه میتواند به دوربین ویدئویی مجهز باشد).

هدف ESP این است که ابتدا یادگیری ماشین خودنظارتی را بر دادههای حاصل از برچسبها اعمال کند تا بهطور خودکار آنچه را که حیوان انجام میدهد (برای مثال اینکه درحال غذا خوردن است، استراحت میکند، حرکت میکند یا با حیوانات دیگر معاشرت دارد) را تجزیهوتحلیل کند و سپس دادههای صوتی را به این اطلاعات اضافه کند تا ببیند که آیا میتوان صداها را با رفتارها ارتباط داد. (آزمایشهای پخش مجدد همراه با صداهایی که قبلا رمزگشایی شده است، میتواند برای تأیید یافتهها مورد استفاده قرار گیرد). این تکنیک ابتدا برای دادههای نهنگ گوژپشت به کار میرود (آزمایشگاه چندین حیوان یک گروه را برچسبگذاری کرده است، بنابراین میتوان نحوه ارسال و دریافت سیگنالها را مشاهده کرد).

البته همهی دانشمندان درمورد قابلیت هوش مصنوعی برای دستیابی به چنین اهداف بزرگی خوشبین نیستند. رابرت سیفرت، استاد بازنشسته روانشناسی در دانشگاه پنسیلوانیا بیش از ۴۰ سال رفتار اجتماعی و ارتباطات صوتی نخستیسانان را در زیستگاه طبیعی آنها مطالعه کرده است. او درحالیکه معتقد است یادگیری ماشین میتواند برای برخی از مسائل مانند شناسایی خزانه آوایی حیوانات مفید باشد، شک دارد که در زمینههای دیگری ازجمله کشف معنا و عملکرد صداها خیلی مفید باشد.

سیفرت توضیح میدهد مشکل اینجا است که درحالیکه بسیاری از حیوانات میتوانند جوامع پیچیدهای داشته باشند، نسبتبه انسانها مجموعهی بسیار کوچکتری از صداها دارند. نتیجه این است که صدای یکسانی میتواند در شرایط مختلف معانی متفاوتی داشته باشد و فقط با مطالعه آن شرایط (مثلا اینکه حیوان با چه کسی تعامل دارد یا کجای سلسله مراتب قرار دارد) است که میتوان امیدوار شد که معنا را کشف کرد. سیفرت میگوید: «فکر میکنم این مدلهای هوش مصنوعی کافی نباشند. باید به آنجا بروید و حیوانات را مشاهده کنید.»

تهیه نقشهی ارتباطات حیوانی نیاز به افزودن پدیدههای غیرصوتی نظیر رقص زنبورهای عسل نیز دارد.

درمورد خود مفهوم نیز تردیدهایی وجود دارد؛ اینکه شکل ارتباطات حیوانات به روش معناداری با شکل ارتباطات انسانی همپوشانی داشته باشد. سیفرت میگوید به کارگیری تجزیهوتحلیلهای مبتنیبر کامپیوتر بر زبان انسان که بهشدت با آن آشنا هستیم، یک مسئله است؛ اما انجام این کار درمورد گونههای دیگر مسئله بسیار متفاوتی است. کوین کافی، عصبشناس دانشگاه واشنگتن که یکی از توسعهدهندگان الگوریتم DeepSqueak است، میگوید: «این ایده هیجانانگیز اما بسیار گسترده است.»

راسکین اذعان میکند که هوش مصنوعی ممکن است به تنهایی برای کشف نحوه ارتباط برقرارکردن ما با گونههای دیگر کافی نباشد؛ اما او به پژوهشهایی اشاره میکند که نشان داده است بسیاری از گونهها به روشهای بسیار پیچیدهتری از آنچه انسان تصور میکند، با هم ارتباط برقرار میکنند.

از موانعی که در گذشته سر راه چنین پژوهشهایی وجود داشته است، توانایی جمعآوری دادههای کافی و تجزیهوتحلیل دادهها در مقیاس بزرگ و همچنین ادراک محدود ما بوده است. او میگوید: «اینها ابزارهایی هستند که به ما اجازه میدهند فراتر از دیدگاه انسانی، کل سیستمهای ارتباطی را درک کنیم.»