در گستره دید اپل؛ از هوشمندی Smart HDR تا ژرفای دیپ فیوژن

«مد پولیور در راه است»؛ این جمله مدتی بعد، از ابتدای مقالهی نیلای پتال (Nilay Patel)، سردبیر نامآشنای سایت ورج حذف شد، اما همان زمان کوتاه کافی بود تا برخی سایتهای خبری حوزهی تکنولوژی، معرفی قابلیت دیپ فیوژن با انتشار تنها چند عکس، آنهم از سوژههایی که همگی پولیور به تن داشتند را دستمایهی تمسخر اپل قراردهند و اصطلاح «مد پولیور» را دستکم برای مدتی کوتاه جایگزین تعبیر فاخر «دیپ فیوژن» کنند. اما نهایتا با ارائهی نسخههای بتای 13.2 iOS در ماه اکتبر، قابلیت دیپفیوژن ابتدا در دسترس توسعهدهندگان و سپس عموم کاربران قرار گرفت و سوژههای متنوعی در قاب دوربین آیفونهای جدید جای گرفتند تا شاید ژرفای درهمآمیزیِ دیپ فیوژن، دیوانگی علم عکاسی محاسباتی را در مجالی فراختر از تاروپود پولیورها نیز به تصویر درآورد.

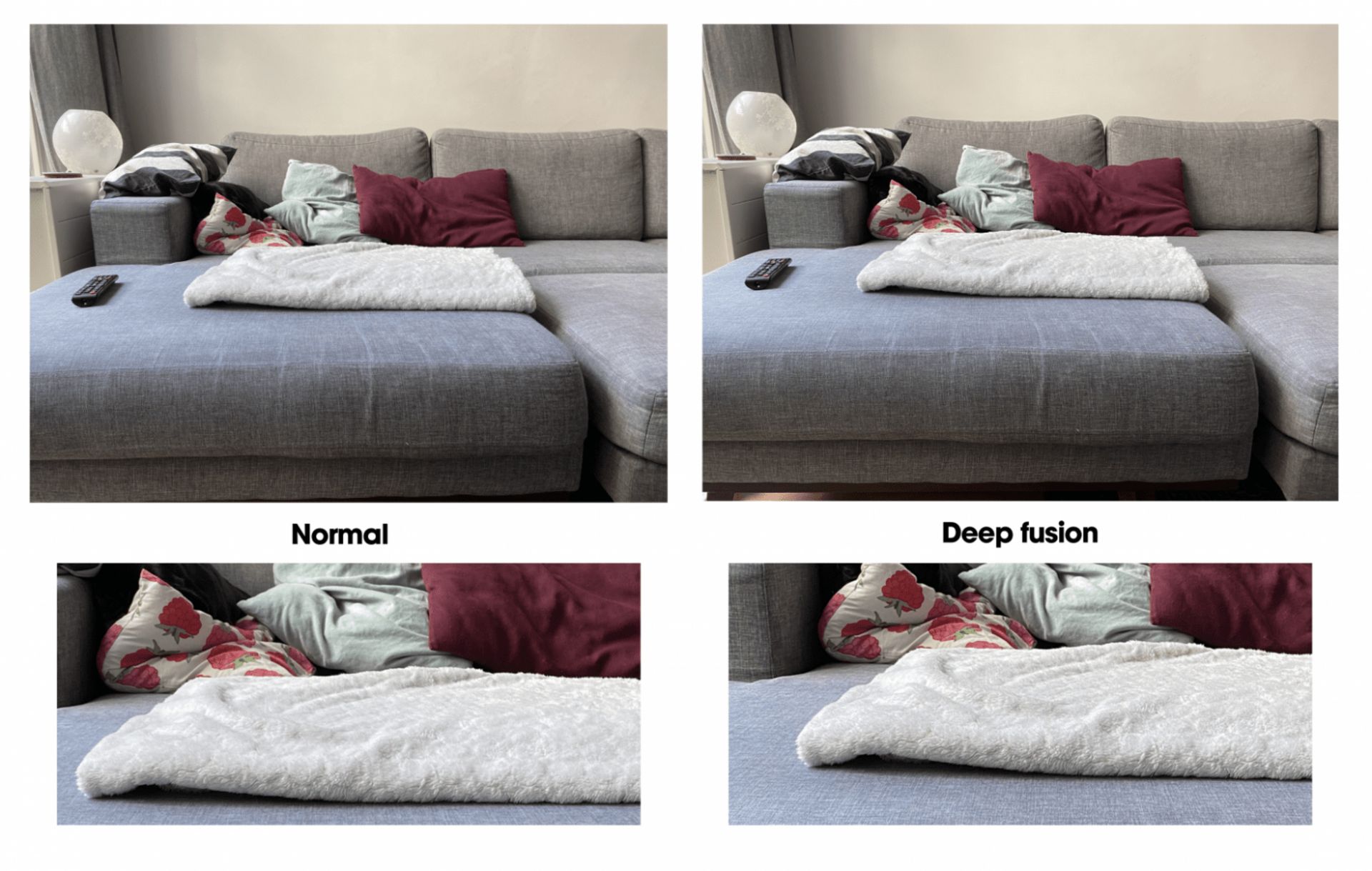

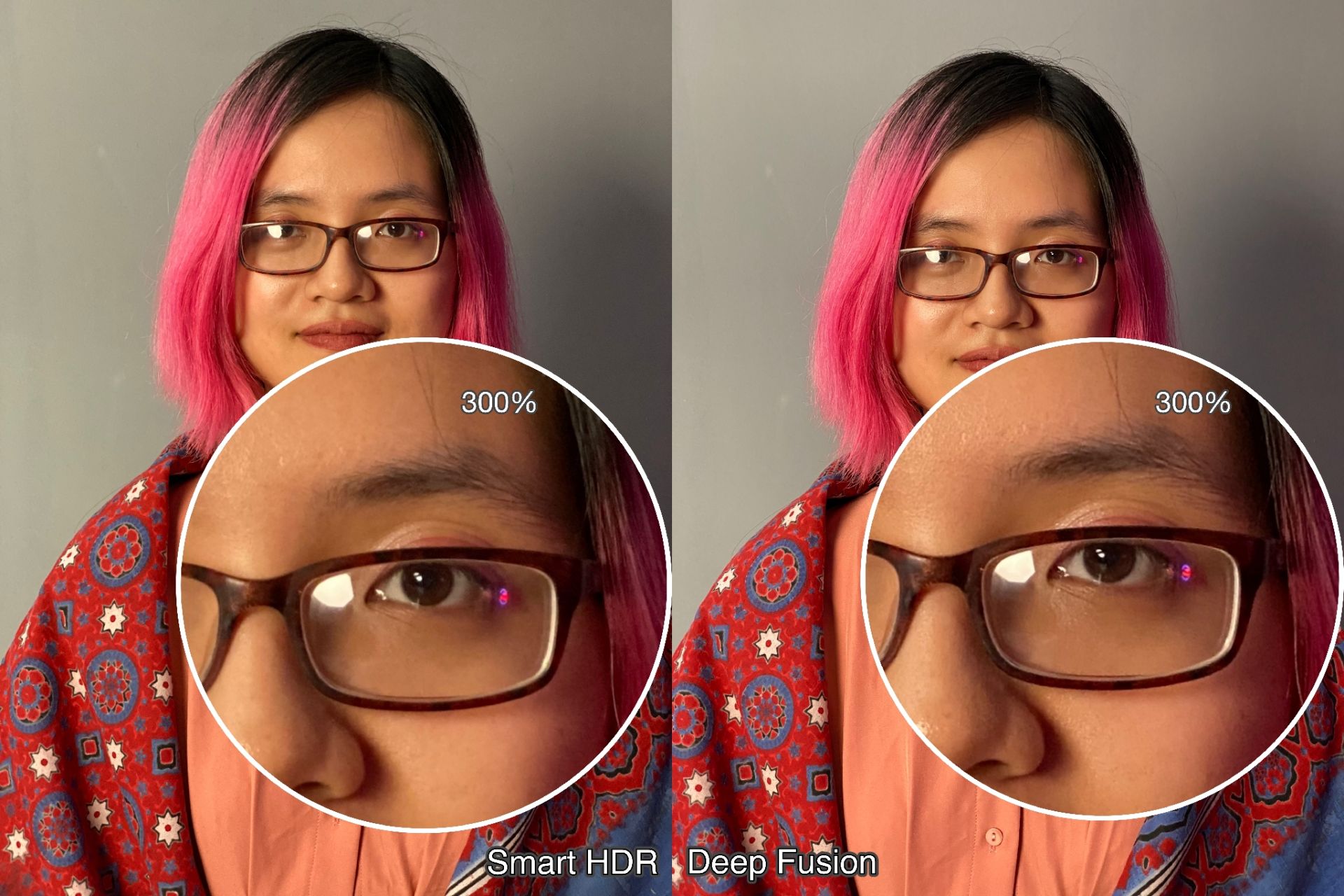

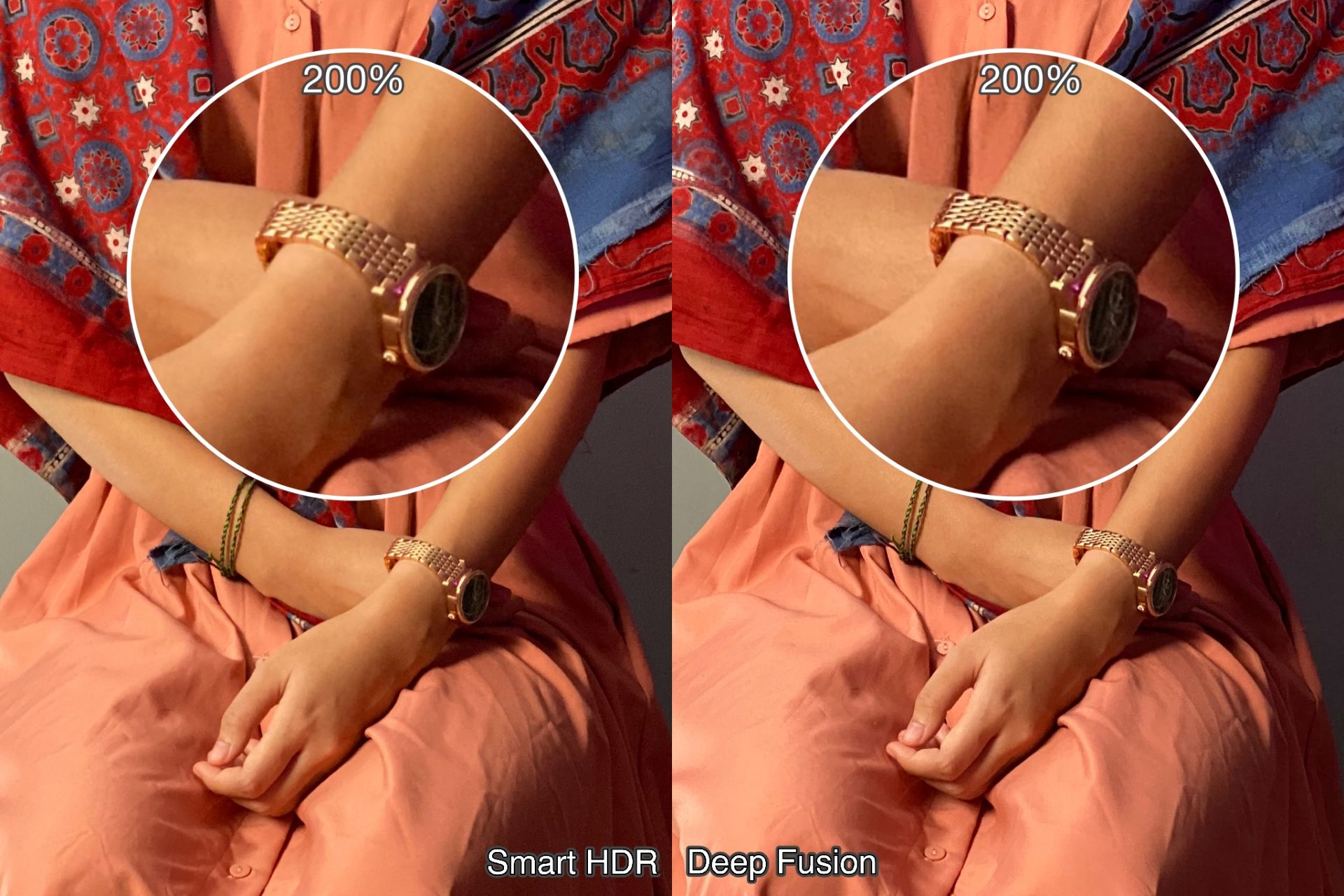

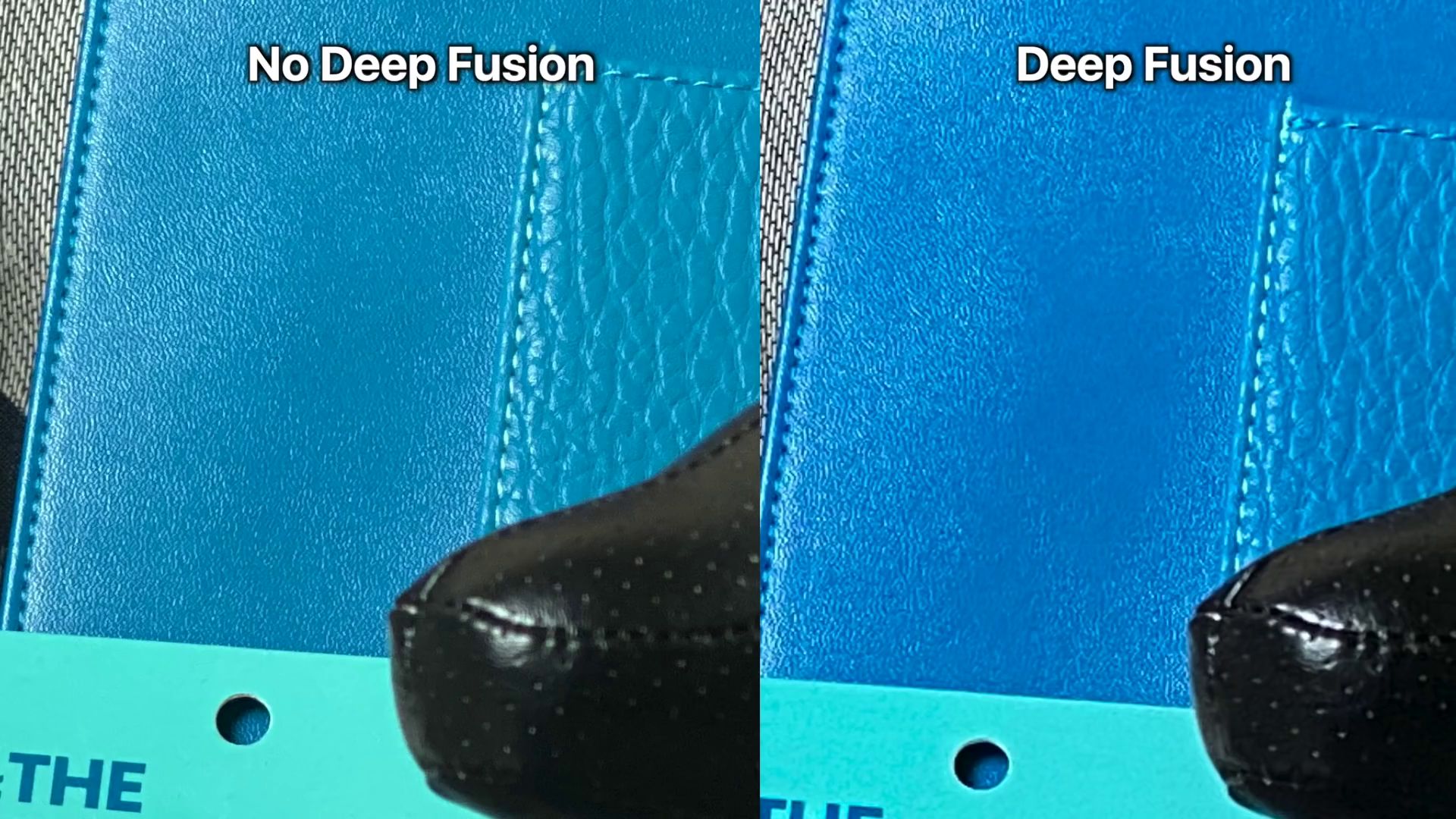

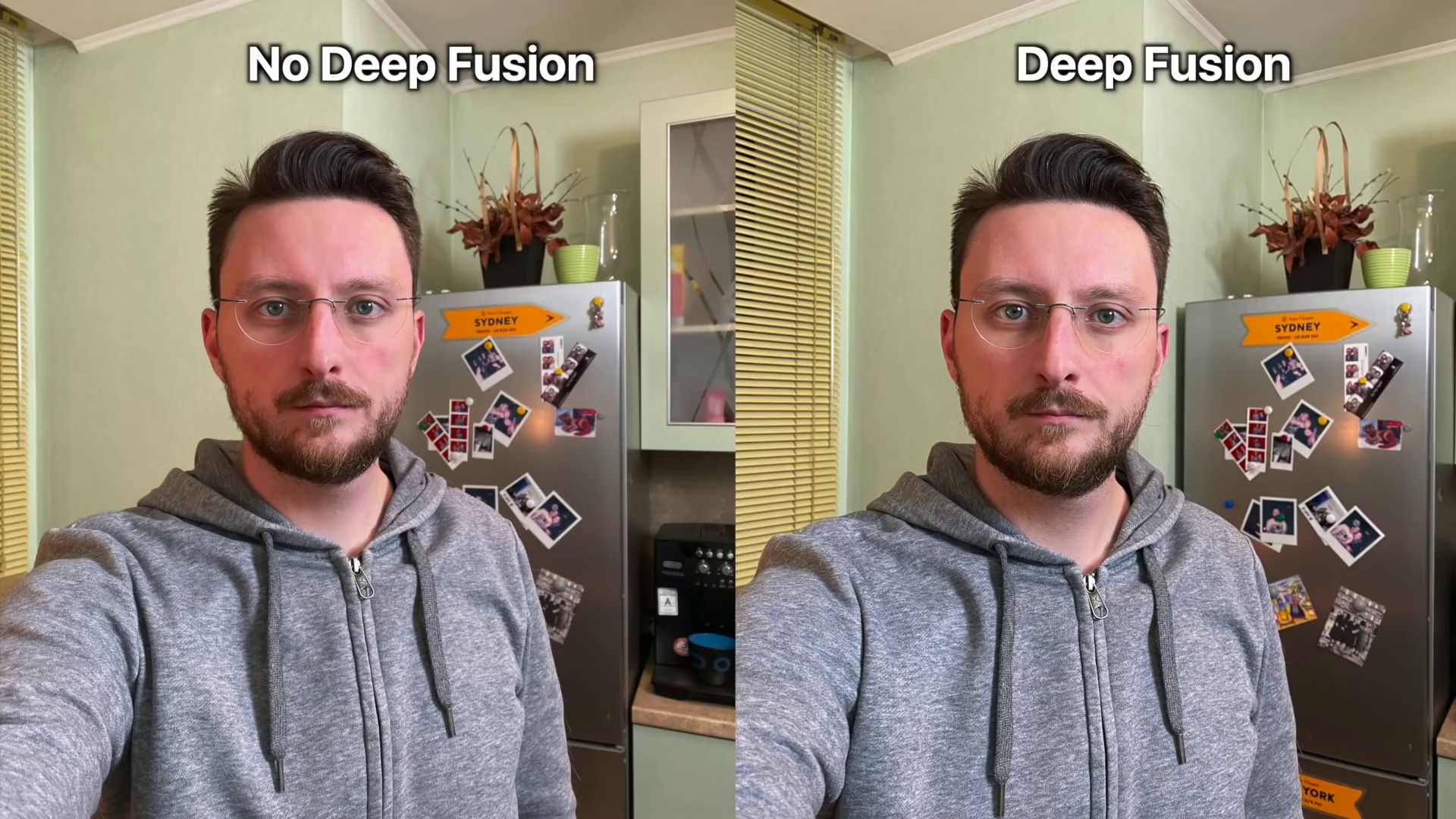

برای مشاهدهی تصاویر در سایز اصلی روی آنها کلیک کنید

دوربینهای سری جدید گوشیهای اپل، سه مد عملکردی Deep Fusion ،Smart HDR و Night Mode را ارائه میکنند و بسته به نور محیط و لنز مورد استفادهی کاربر، مد مناسب بهصورت خودکار فعال میشود:

با فعالشدن Night Mode، آیکون زردرنگی در کنار نشانگر فلش به نمایش درخواهد آمد و کاربر با لمس آن، علاوهبر تنظیم زمان نوردهی، امکان غیرفعال کردن این مد را نیز خواهد داشت. مد Smart HDR را نیز میتوان از طریق تنظیمات دوربین غیرفعال کرد و فعالسازی مجدد آن نیز از طریق نشانگر موجود در اپلیکیشن دوربین امکانپذیر است. اما Deep Fusion بدون اطلاع کاربر فعال شده و تماما از دید وی پنهان است. این مد نه نشانگری در اپلیکیشن دوربین دارد و نه میتوان در دادهی اگزیف عکس اثری از آن یافت. بااینکه برخی این احتمال را همچنان مطرح میدانند که در بهروزرسانیهای آتی iOS و خصوصا در نسخهی اصلی 13.2 iOS امکان دسترسی کاربر به تنظیمات این مد فراهم شود، اما طبق آنچه در مقالهی نیلای پتال به نقل از اپل میخوانیم، پنهانکردن تنظیمات این مد از دید کاربر، تعمدی بوده و ایدهی اصلی از ارائهی این تکنولوژی آن است که «دوربین همهی آنچه را که لازم است، انجام دهد و نیازی نباشد کاربر به اینکه چطور بهترین عکس را بگیرد فکر کند.»

راست: آیکون نشانگر فعالبودن Night Mode، چپ: فعال/غیرفعال کردن Smart HDR از طریق تنظیمات دوربین

البته درحال حاضر یک روش غیرمستقیم برای غیرفعال کردن دیپ فیوژن وجود دارد که متیو پنزارینو (Matthew Panzarino)، سردبیر تککرانچ، از آن با عنوان «هک جزئی» یاد کرده است؛ همچنان که پیشتر اشاره شد، لنز اولتراواید، مد Deep Fusion را پشتیبانی نمیکند و از طرفی با فعالبودن قابلیت «ثبت تصاویر خارج از فریم» در تنظیمات دوربین، صرفنظر از نوع لنز انتخابشده توسط کاربر، دوربین از لنز اولتراواید نیز برای ثبت حاشیههای کناری تصاویر استفاده خواهد کرد؛ بنابراین با فعالکردن قابلیت «ثبت تصاویر خارج از فریم»، Deep Fusion غیرفعال خواهد شد. البته در صورت غیرفعال بودن این گزینه، الزاما Deep Fusion فعال نمیشود و دوربین بسته به لنز مورد استفادهی کاربر و میزان نور محیط، مد مناسب را انتخاب خواهد کرد.

فعال/غیرفعالکردن قابلیت «ثبت تصاویر خارج از فریم» در تنظیمات دوربین

ظاهرا درحال حاضر Deep Fusion تنها یک نشانگر اختصاصی و منحصربهفرد دارد؛ درصورتیکه بعد از ثبت عکس در این مد روی آن کلیک کنید، بعد از حدود یک ثانیه شاهد شیفت جزئی تصویر خواهید بود!

شیفت جزئی تصویر ثبتشده در مد Deep Fusion

اما Deep Fusion چیست و چرا فیل شیلر در توصیف آن از عبارت «علم دیوانهی عکاسی محاسباتی» استفاده کرد؟ چرا همین علم، وقتی شیلر در رویداد سال گذشتهی اپل تکنولوژی Smart HDR را معرفی میکرد، شایستهی لقب دیوانه نبود؟ واقعیت آن است که اطلاعات موجود در خصوص جزئیات نحوهی عملکرد گوشی در این مد، کماکان مختصر، گنگ و بعضا حتی متناقضاند، و قابل استنادترین منبع همان مقالهی نیلای پتال است که به نقل از اپل مراحل عملکرد گوشی را در این مد تا حدی تشریح کرده است. در ادامه، پس از مقدمهای دربارهی تصاویر HDR و نگاهی گذرا به پایپلاین تصویر در آیفون، اشارهای خواهیم داشت به نحوهی ثبت تصاویر در مد Smart HDR؛ و در نهایت مراحل عملکرد گوشی در مد Deep Fusion را نیز به نقل از مقالهی نیلای پتال، از نظر خواهیم گذراند.

درباره تصاویر HDR

سایه روشن رویایی غروب بر بلندای قلهها، سماعِ پرتوهای نور در طلاییِ خاموش گندمزارها، یا جسارتِ آفتاب زمستانی در بلورِ دانههای برف؛ مسحورِ زیباییهای یک منظرهی طبیعی، وسوسهی دست به دوربین شدن را تاب نمیآورید و بله! آنچه در قاب دوربینتان جای میگیرد، همانقدر دلسردتان میکند که آنچه با چشم دیده بودید به وجدتان آورده بود. واقعیت آن است که دنیا از پشت لنز بهترین دوربینها هم، به زیبایی آنچه با چشمانتان میبینید نخواهد بود و علم عکاسی محاسباتی گویا در همین مصاف نابرابر است که هشیاری از کف داده تا شاید، غم «مغلوب شاهکارِ خلقت بودن» را از دل بزداید.

(البته طبیعتا کیفیت نوردهی عکس نهایی را نمیتوان «صرفا» بر مبنای آنچه در نمایشگر دوربین، آنهم پیش از اعمال تنظیمات نوردهی مشاهده میشود ارزیابی کرد و از تأثیر نور محیط و روشنایی صفحهی نمایش نیز در آنچه از پشت لنز دوربین و روی صفحهی نمایشگر میبینیم، نباید غافل بود و بررسی هیستوگرام دوربین را نیز نباید از نظر دور داشت؛ اما معمولا صحنهای که برای ثبت جزئیات آن ناچار به استفاده از تکنیک HDR هستیم، بهدلیل کنتراست بالا در نمایشگر دوربین هم قابل تشخیص است.)

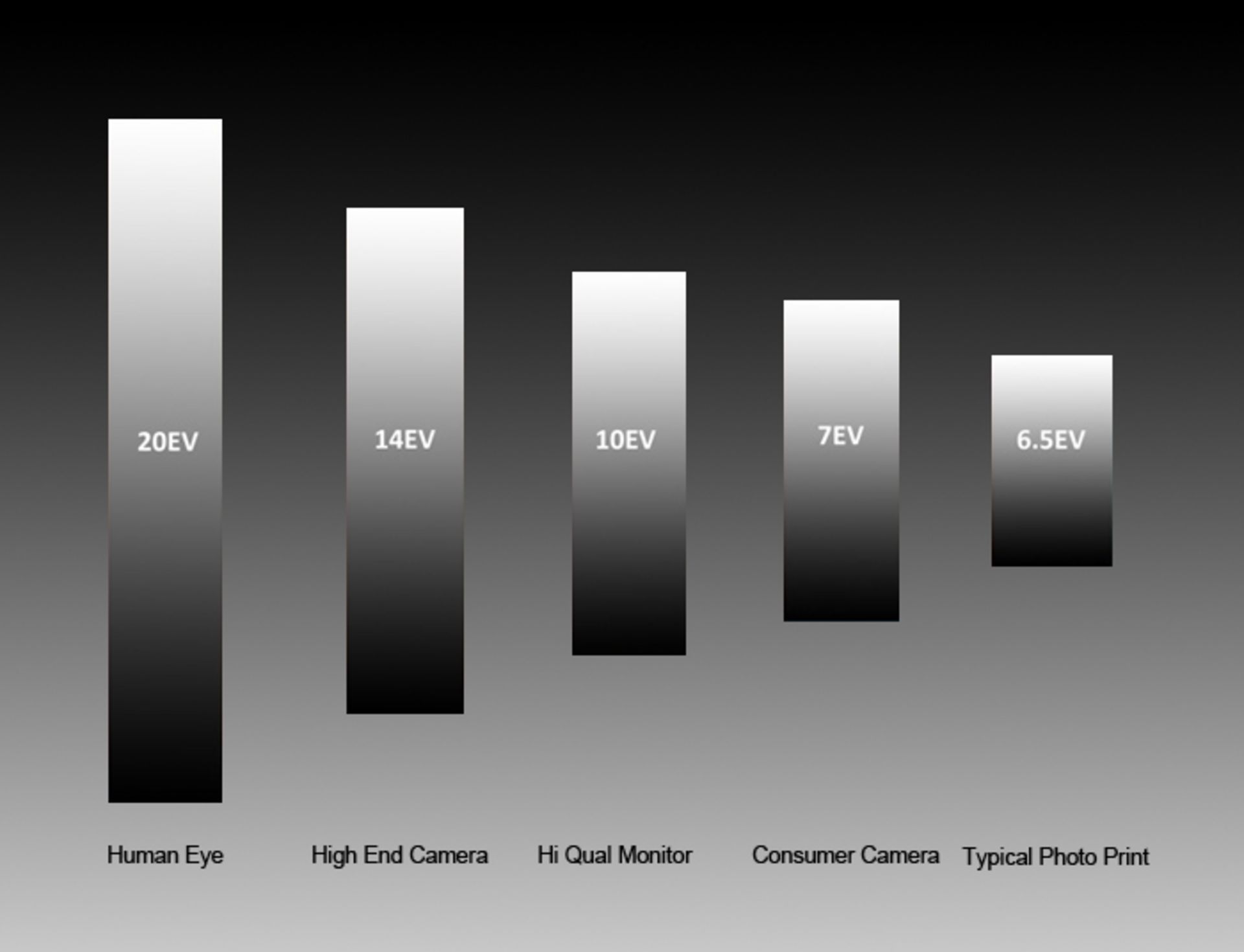

اما این شاعرانههای پائیزی بهکنار، منظور از دامنهی دینامیکی در یک عکس چیست؟ و اساسا عکس چیست؟ کلمهی «photograph» برگرفته از دو واژهی یونانی «phos» بهمعنای نور و «graphe» بهمعنای نوشتن یا ترسیمکردن است. هرچند شاید بازهم شاعرانه بهنظر برسد، اما عکاسی در حقیقت نقاشی با نور است؛ پس هرقدر توانایی دوربین در تشخیص تنوع درجات روشنایی بیشتر باشد، تصویر ثبتشده به واقعیت نزدیکتر خواهدبود. تفاوت میزان روشناییِ تاریکترین و روشنترین نقاطِ دارای جزئیات قابل تشخیص در یک تصویر (یا صحنه) را اصطلاحا محدودهی دینامیکی میگویند که واحد سنجش آن EV ( مخفف Exposure Value) یا بهطور معادل استاپ (stop یا گام نوری) است. یک واحد افزایش EV بهمعنای دو برابر شدن میزان نور و یک واحد کاهش آن، بهمعنای نصفشدن میزان نور است.

علاوهبر محدودهی دینامیکی سوژه، آنچه در هنگام عکاسی لازم است مورد توجه قرار گیرد، دامنهی دینامیکی دوربین است. هرچه توانایی دوربین در ثبت جزئیات تاریکترین و روشنترین نقاط صحنه (در آن واحد) بیشتر باشد، دامنهی دینامیکی دوربین وسیعتر است. روشنایی موجود در طبیعت، دامنهی دینامیکیای برابر با ۳۰ استاپ دارد و رنج دینامیکی صحنهای با نور طبیعی تقریبا برابر با ۱۸ استاپ است که چشم انسان (در گشودگی عنبیه ثابت)، حدود ۱۷ استاپ از این محدوده را پوشش میدهد. درصورتیکه باز و بستهشدن عنبیه برای تطبیق با روشنایی نواحی مختلف را نیز مجاز بدانیم، دامنهی دینامیکی چشم انسان حدود ۳۰ استاپ خواهد بود؛ یعنی اگر میزان نور در روشنترین ناحیهی صحنه، ۲ به توان ۳۰ برابر بیش از تاریکترین ناحیه باشد (حدود یک میلیارد برابر!)، چشم انسان قدرت تشخیص جزئیات در هر دو ناحیه را خواهد داشت (البته ازآنجاکه در این حالت چشم مانند دوربین فیلمبرداری، قطر عنبیه را برای تطبیق با شرایط نوری مختلف تنظیم میکند، قیاس این رنج دینامیک با محدودهی دینامیکی دوربین عکاسی صحیح نیست). این درحالی است که دامنهی دینامیکی دوربینهای عکاسی در حدود ۱۰ الی ۱۴ استاپ است و جالبتر اینکه رنج دینامیکی نمایشگر دوربین و عکس پرینتشده در حدود ۱۰ استاپ است؛ بنابراین بخشی از اطلاعاتی که دوربین از صحنه دریافت کرده، در عکس پرینتشده یا در نمایشگر خود دوربین هم قابل مشاهده نخواهد بود.

اگر روشنایی موجود در صحنه در دامنهی دینامیکی چشم انسان باشد ولی در رنج دینامیکی دوربین نباشد، ناحیهی موردنظر بهصورت کاملا سفید یا کاملا سیاه ثبت میشود

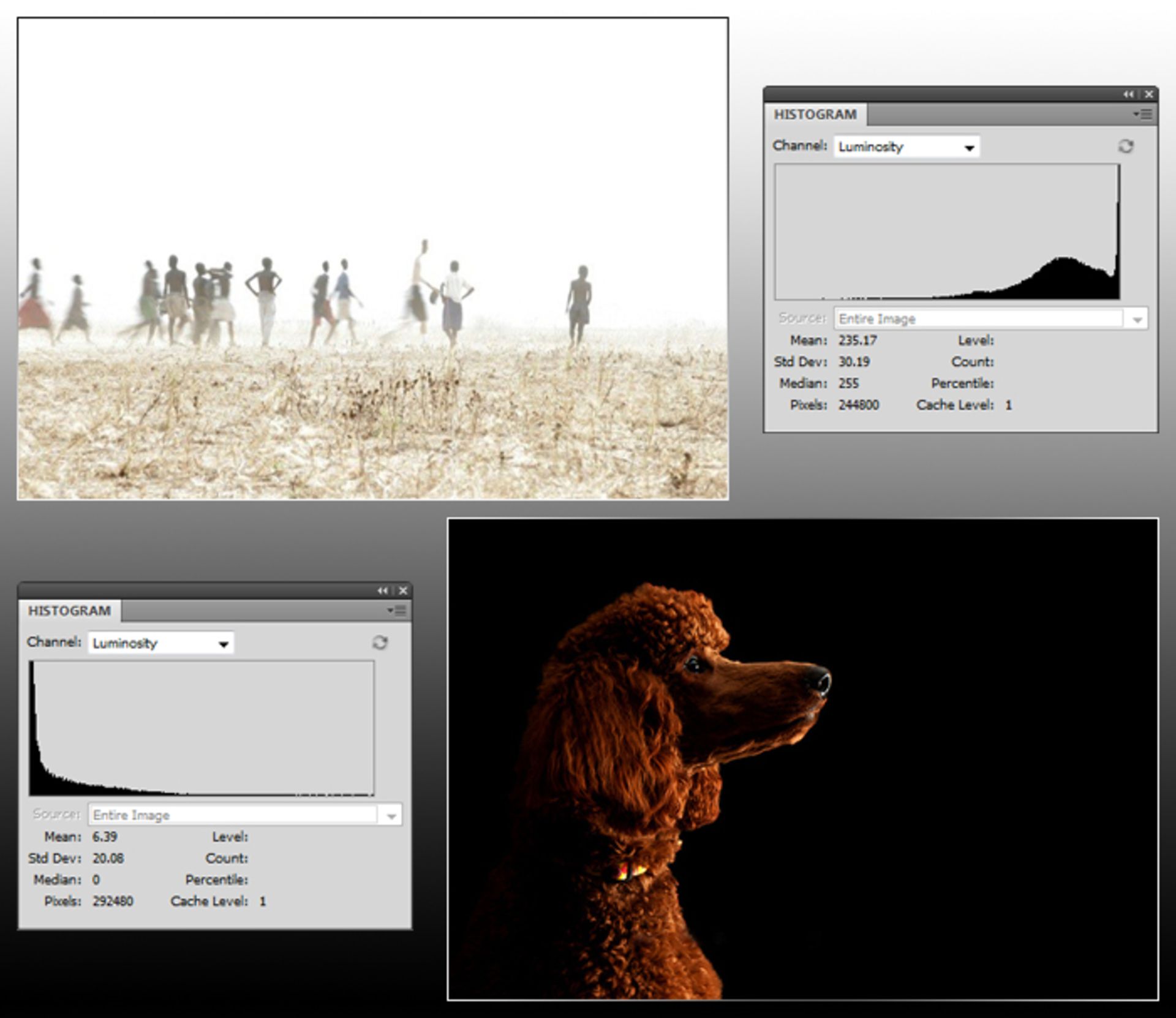

اگر رنج دینامیک سوژه گستردهتر از دامنهی دینامیکی دوربین باشد، جزئیات نقاط روشن (Highlights) یا نقاط تاریک (Shadows) صحنه یا هر دو، بهطور کامل ثبت نخواهند شد. بنابراین دوربینی با رنج دینامیکی بالاتر، میتواند جزئیات نقاط روشنتر و تاریکتری از صحنه را در آن واحد ثبت کند. همچنانکه پیشتر اشاره شد، آنچه در نمایشگر دوربین مشاهده میشود، همیشه معیار مناسبی برای قضاوت درخصوص کیفیت نهایی تصویر ثبتشده نخواهد بود و خصوصا برای بررسی اینکه آیا دوربین دامنهی دینامیکی صحنه را پوشش میدهد یا خیر، هیستوگرام گزینهی بهمراتب قابل اطمینانتری است. با بررسی هیستوگرام روشنایی (luminosity histogram) در دوربین، میتوان علاوهبر مشاهدهی چگونگی توزیع پیکسلها در درجات مختلف روشنایی، وجود نواحی خارج از رنج دینامیکی دوربین در صحنه را نیز تشخیص داد.

هیستوگرام دوربین

محور افقی هیستوگرام درجات مختلف روشنایی از ۰ (سفید) تا ۲ بهتوان عمقبیتی دوربین، منهای یک (سیاه) را مشخص میکند و محور عمودی، تعداد پیکسل در هر درجهی روشنایی را برمبنای نمایش خاکستریمقیاسی (Gray Scale) از صحنه نشان میدهد. درجات مختلف روشنایی در این نمودار، به ۵ ناحیه تقسیم میشوند:

نمودار هیستوگرام

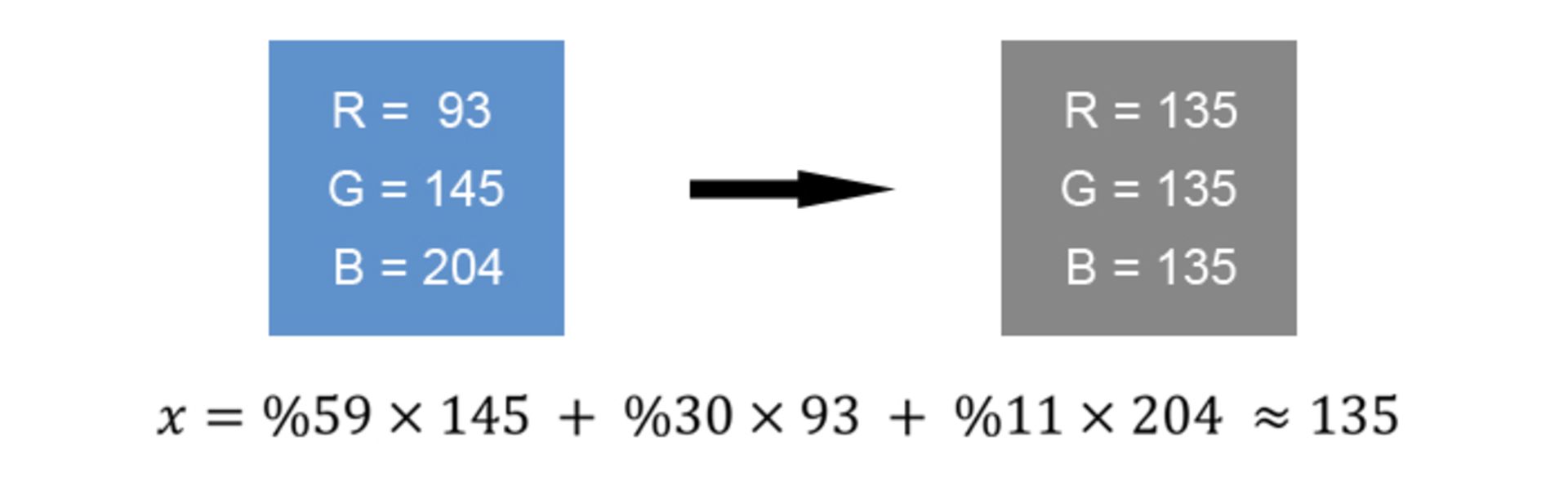

منظور از روشنایی در این نمودار، میزان نور دریافتشده از صحنه است و باتوجه به اینکه حساسیت چشم انسان به نور سبز بیش از قرمز و به نور قرمز نیز بیش از آبی است، درجهی روشنایی در نمایش خاکستریمقیاس صحنه، میانگین وزندهیشدهی این سه رنگ در نمایش رنگی دریافتشده توسط دوربین خواهد بود. سهم رنگ سبز در این میانگین ۵۹%، قرمز ۳۰% و آبی ۱۱% درصد است. مثلا در دوربینی با عمق بیتی ۸، که توانایی تشخیص ۲۵۶ (۲ بهتوان ۸) تون رنگی مختلف در هر کانال رنگ را دارد (از ۰ تا ۲۵۵)، اگر سهم کانالهای رنگی قرمز، سبز و آبی در یک پیکسل بهترتیب ۹۳، ۱۴۵ و ۲۰۴ باشد (در نمایش رنگی دریافتشده توسط دوربین)، درجه روشنایی آن در نمایش خاکستریمقیاس صحنه برابر با ۱۳۵ خواهد بود؛ یا اگر دوربین رنگ ناحیهای از سوژه را سفید تشخیص دهد، سهم هر سه کانال رنگی در پیکسلهای آن ناحیه، برابر ۲۵۵ خواهد بود و درجه روشنایی آن در نمایش خاکستریمقیاس صحنه نیز برابر ۲۵۵ است.

در صورتیکه رنج دینامیکی سوژه گستردهتر از دامنهی دینامیکی دوربین باشد، نواحی بسیار روشن صحنه به رنگ سفید و نواحی بسیار تاریک به رنگ سیاه ثبت میشوند، بنابراین جهش بلندی در منتهیالیه سمت راست یا چپ هیستوگرام وجود خواهد داشت و در صورت ثبت عکس، تصویر شامل نواحی کاملا سفید (نواحی overexposed یا با نوردهی بیشازحد) یا کاملا سیاه (نواحی underexposed یا با نوردهی ناکافی) خواهد بود. به عبارت دیگر، وجود قله در منتهیالیه سمت راست نمودار، نشاندهندهی چگالی پیکسل بالای نقاط پرنورِ فاقد جزئیات در بخشهایی از تصویر است و در منتهیالیه سمت چپ، نشاندهندهی چگالی پیکسل بالای نقاط کمنورِ فاقد جزئیات است. بنابراین بریدهشدن قسمتهای روشن (Highlight clipping) یا تاریکِ (Shadow clipping) صحنه، با بررسی هیستوگرام دوربین قابل تشخیص بوده و (بهجز مواردی که برای خلق یک جلوهی تصویری خاص، عمدا عکس اوراکسپوزد یا آندراکسپوزد میگیریم) لازم است با تغییر نوردهی، مانع از حذف جزئیات صحنه شویم.

ثبت عکس اوراکسپوزد (بالا) یا آندراکسپوزد (پایین) بهمنظور خلق جلوهی هنری

طبیعتا افزایش نوردهی به منظور حفظ جزئیات نواحی تاریک یا کاهش آن با هدف حفظ جزئیات نواحی روشن، درجهی روشنایی تمامی پیکسلهای موجود در تصویر را تغییر خواهد داد. بنابراین علاوهبر تغییر شکل کلی نمودار، افزایش نوردهی باعث شیفت هیستوگرام به سمت راست و کاهش آن باعث شیفت نمودار به سمت چپ خواهد شد؛ لذا در صحنههایی با کنتراست فوقالعاده بالا که وجود قله در هر دو سمت هیستوگرام را شاهد هستیم، حفظ همزمان جزئیات در نواحی پرنور و کمنور، تنها با تغییر میزان نوردهی امکانپذیر نخواهد بود؛ چراکه تغییر میزان نوردهی و به تبع آن شیفت نمودار به یکی از دو سمت، اگرچه قلهی موجود در یک سمت را از محدودهی فاقد جزئیات خارج میکند، اما همزمان قلهی سمت دیگر را وارد محدودهی فاقد جزئیات خواهد کرد. بنابراین در صحنههایی که برقراری تعادل بین جزئیات از دسترفته در نواحی تاریک و روشن، یا حفظ جزئیات یکی از دو ناحیه به بهای از دسترفتن جزئیات ناحیهی دیگر، تصویر مطلوبی بهدست نمیدهد، ناچاریم برای ثبت عکسی با دامنهی دینامیکی وسیعتر از گسترهی تحت پوشش دوربین، از تلفیق چندین تصویر با نوردهیهای متفاوت استفاده کنیم که این تکنیک را اصطلاحا HDR میگویند. هدف اصلی از بهکارگیری تکنیک HDR، ثبت نمایی واقعگرایانه از صحنه است که به آنچه با چشم میبینیم بیشترین شباهت را داشته باشد؛ بااینحال قابلیتهای این تکنیک در خلق تصاویر سورئال را نیز نمیتوان از نظر دور داشت.

خلق تصاویر سورئال با استفاده از تکنیک HDR

تا اینجا دانستیم که برای درک جزئیات سوژه، لازم است گسترهی دینامیکی دید ناظر از دامنهی دینامیکی روشناییهای سوژه وسیعتر باشد؛ اما همین معنا را گویا خواجهی شیراز هم ۶ قرن پیش، به سروشی از عالم غیب وجدان کرده بود که بلندنظرانِ از محنتآباد دنیا رهیده را، همآوا با صفیری از بلندای کنگرهی عرش، به منتهای گسترهی دینامیکیِ «بودن» انسان فرا میخواند؛ که تنگنظرانِ در دامگهِ دنیا گرفتارآمده را، یارای پرگشودن به آنسوی روشناییها نیست و مأواگرفتن در اوج سدرةالمنتهی را، شاهبازی باید و بس.

پیش از آنکه بیش از اینها از گسترهی دید اپل خارج شویم، در ویدئوی زیر مختصر مروری بر مقدمات عکاسی خواهیم داشت و پس از نگاهی گذرا به پایپلاین تصویر در آیفون، عملکرد گوشی در مد Smart HDR و سپس Deep Fusion را بررسی خواهیم کرد.

لینک سایت اول | لینک سایت دوم | دانلود از آپارات

پایپلاین تصویر در آیفون

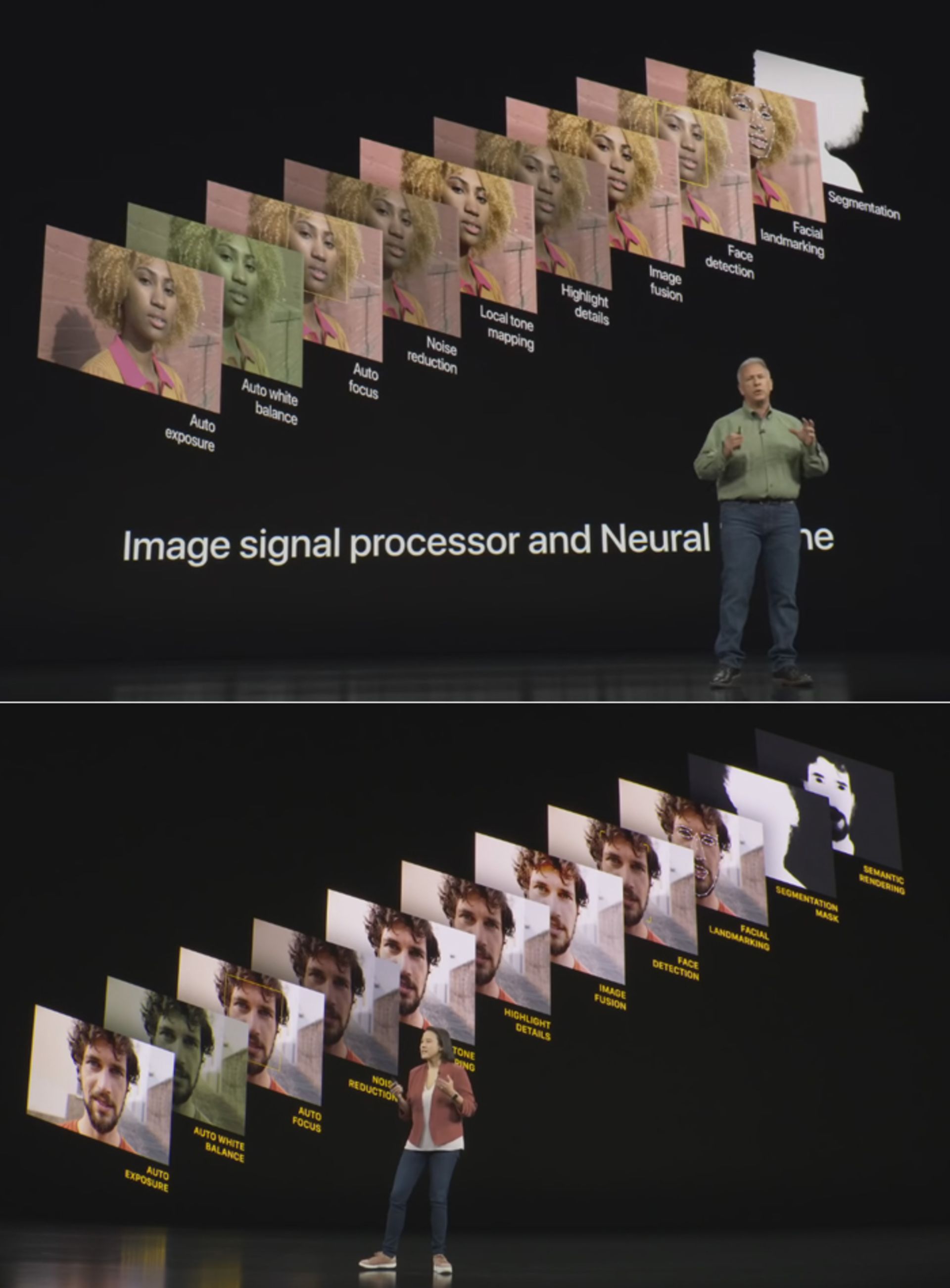

تمامی عکسهای ثبتشده بهوسیلهی دوربین آیفون، پیش از نمایش از چند مرحلهی پردازش دیجیتال عبور میکنند. این مراحل میانی را اصطلاحا پایپلاین تصویر مینامند (البته در حالت کلی، پایپلاین تصویر تعریف وسیعتری دارد). سیستم روی چیپِ بایونیک A13 (یا A12 در آیفونهای سری قبل)، مجهز به یک واحد پردازش سیگنال تصویر (ISP یا Image Signal Processor) است که بههمراه CPU، هفت مرحله پردازش شامل تنظیم خودکار نوردهی، تعادل رنگ سفید و فوکوس، کاهش نویز، Local Tone Mapping، تشخیص جزئیات و تلفیق تصاویر را روی تمامی عکسهای ثبتشده با دوربین آیفون اعمال میکند.

پایپلاین تصویر در آیفونهای مجهز به بایونیک A12 (بالا) و A13 (پایین)

اما آن بخش از عملکرد بایونیک A12 در پردازش تصاویر که طبق گفتهی شیلر تماما جدید است، ارتباط ISP و CPU با موتور عصبی ۸ هستهای این چیپ است که شناسایی مشخصات سوژه بهکمک یادگیری ماشین را امکانپذیر میکند. سه مرحلهی بعدی در پایپلاین تصویر شامل تشخیص چهره، نشانگذاری اجزاء صورت (Facial Landmarking)، و قطعهبندی تصویر در آیفونهای مجهز به بایونیک A12 (سری قبل) حاصل مشارکت موتور عصبی در روند پردازش تصاویر است. در آیفونهای مجهز به بایونیک A13 (سری جدید)، مرحلهی چهارمی نیز تحت عنوان رندر معنایی (Semantic Rendering) به مراحل پردازش تصویر افزوده شده است. معناشناسی یا «semantics» در هوش مصنوعی، بهمعنای توانایی ماشین در طبقهبندی هوشمندانهی دادهها به طریقی مشابه انسان است. قطعهبندی معنایی (Semantic Segmentation) تصاویر، بهمعنای ردهبندی تکتک پیکسلهای موجود در یک تصویر در چندین کلاس مشخص است؛ مثلا در تصویر زیر پیکسلهای موجود در کلاسهای درخت، جاده، ماشین و انسان، هر یک با رنگی متفاوت نمایش داده شدهاند. درواقع ماشین نهتنها صحنه را میبیند بلکه مانند انسان، معنای آنچه را که میبیند نیز (البته تا حدی) میداند.

قطعهبندی معنایی در شاخههای مختلف یادگیری ماشین کاربردهای متفاوتی دارد و در عکاسی، با شناسایی سوژه آغاز میشود. رندر معنایی تصاویر در آیفونهای جدید، تنها روی سوژههای انسانی اعمال میشود؛ پس از تشخیص افراد موجود در کادر، پیسکلهای نواحی مختلف شامل مو، چشم، ابرو، پوست و... در کلاسهای متفاوت طبقهبندی میشوند و بهاین ترتیب پردازشهای اعمالی روی نواحی مختلف تصویر بسته به اینکه پیکسل متعلق به کدام کلاس است متفاوت خواهد بود؛ مثلا همزمان با کاهش روشنایی آسمان برای مشخصشدن جزئیات، روشنایی پوست صورت کمتر کاهش مییابد یا افزایش میزان وضوح (sharpness) تصویر در پیکسلهای متعلق به دو کلاس مو و چشم یکسان نخواهد بود. در آیفونهای سری جدید ضمن عبور هر تصویر از این پایپلاین، بیش از ۱ تریلیون عملیات روی آن انجام میشود (رندر آخرین مرحله در یک پایپلاین تصویر بوده که بهمعنای ارائهی تصویر نهایی است؛ نمایشگر کامپیوتر، صفحهی نمایش گوشی و پرینتر از انواع رندررها بهشمار میروند).

Smart HDR

«آنچه این روزها ثبت تصاویر باورنکردنی را بیش از گذشته امکانپذیر میکند، تنها لنزها و سنسورها نیستند؛ بلکه چیپ مورداستفاده و نرمافزاری است که روی آن اجرا میشود.» این جملهی فیل شیلر در توصیف Smart HDR و اشارهی وی به مشارکت موتور عصبی چیپ بایونیک A12، واحد پردازش سیگنال و CPU در روند پردازش تصاویر در این تکنولوژی، بیانگر بهینهسازی تصاویر با بهرهگیری از علم عکاسی محاسباتی است؛ بنابراین طبیعتا تشریح عملکرد گوشی در این مد هم، مانند مد Deep Fusion، بهمعنای بیان جزئیات آنچه در مراحل پردازش تصویر اتفاق میافتد نخواهد بود و آنچه خواهید خواند، صرفا توصیفی از کلیات مراحل عملکرد گوشی در این مد بوده که در اختیار رسانهها است. البته برخلاف نگاه گذرای فیل شیلر به تکنولوژی دیپ فیوژن در رویداد امسال، توضیحات وی در معرفی Smart HDR ضمن رویداد سال گذشتهی اپل، واضح و نسبتا کامل بود و خوشبختانه در مورد این تکنولوژی، منبع قابلاطمینانی برای شروع در اختیار داریم.

مثالی عالی از نحوهی عملکرد Smart HDR در یک صحنهی با رنج دینامیکی بالا

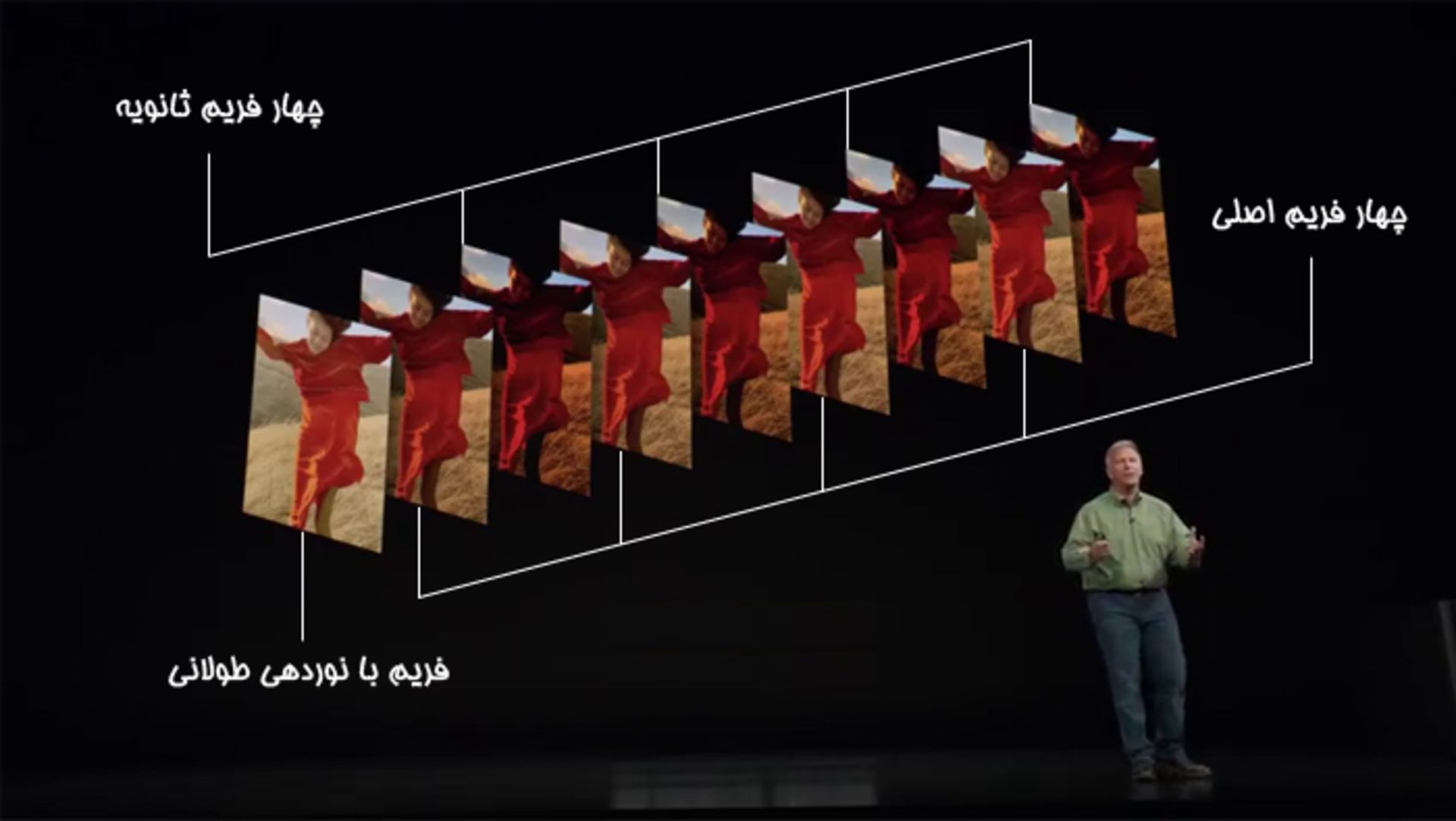

شیلر معرفی Smart HDR را با مثالی از یک سوژه متحرک آغاز کرد که دوربین آیفون، درست در همان لحظهی فشردهشدن دکمهی شاتر، تصویر آن را ثبت میکند؛ همچنانکه میدانید در عکاسی با تأخیر شاتر صفر (Zero Shutter Lag یا ZSL) دوربین بهطور پیوسته و در فواصل زمانی ثابت، تصاویری از صحنه را ثبت کرده و تعداد مشخصی از آنها را در یک بافر دایرهای (circular buffer: با ذخیرهی هر تصویر جدید، یک تصویر از ابتدای حافظه حذف میشود) ذخیره میکند؛ عکس نهایی تصویری است که دقیقا در لحظهی فشردهشدن دکمهی شاتر یا کمی قبل از آن (آخرین تصویر موجود در بافر) ثبت شده است. طبق گفتهی شیلر، چیپ بایونیک A12 علاوه بر ذخیرهی تصاویر در یک بافر چهار فریمی، فریمهای میانی ثانویهای را نیز همزمان با چهار فریم اصلی ولی با نوردهیهای متفاوت ثبت میکند؛ طبیعتا هدف از ذخیرهی این چهار فریمِ با نوردهی کوتاه، ثبت جزئیات نواحی روشن صحنه است. همزمان با ثبت تصویر آخر که یک فریم با نوردهی طولانی است، پردازش و آنالیز فریمها بهمنظور تلفیق بهترین قسمتهای هر فریم برای ساخت تصویر نهایی نیز انجام میشود. طبیعتا هدف از ثبت این فریم هم مشخصشدن جزئیات نواحی تاریک صحنه است.

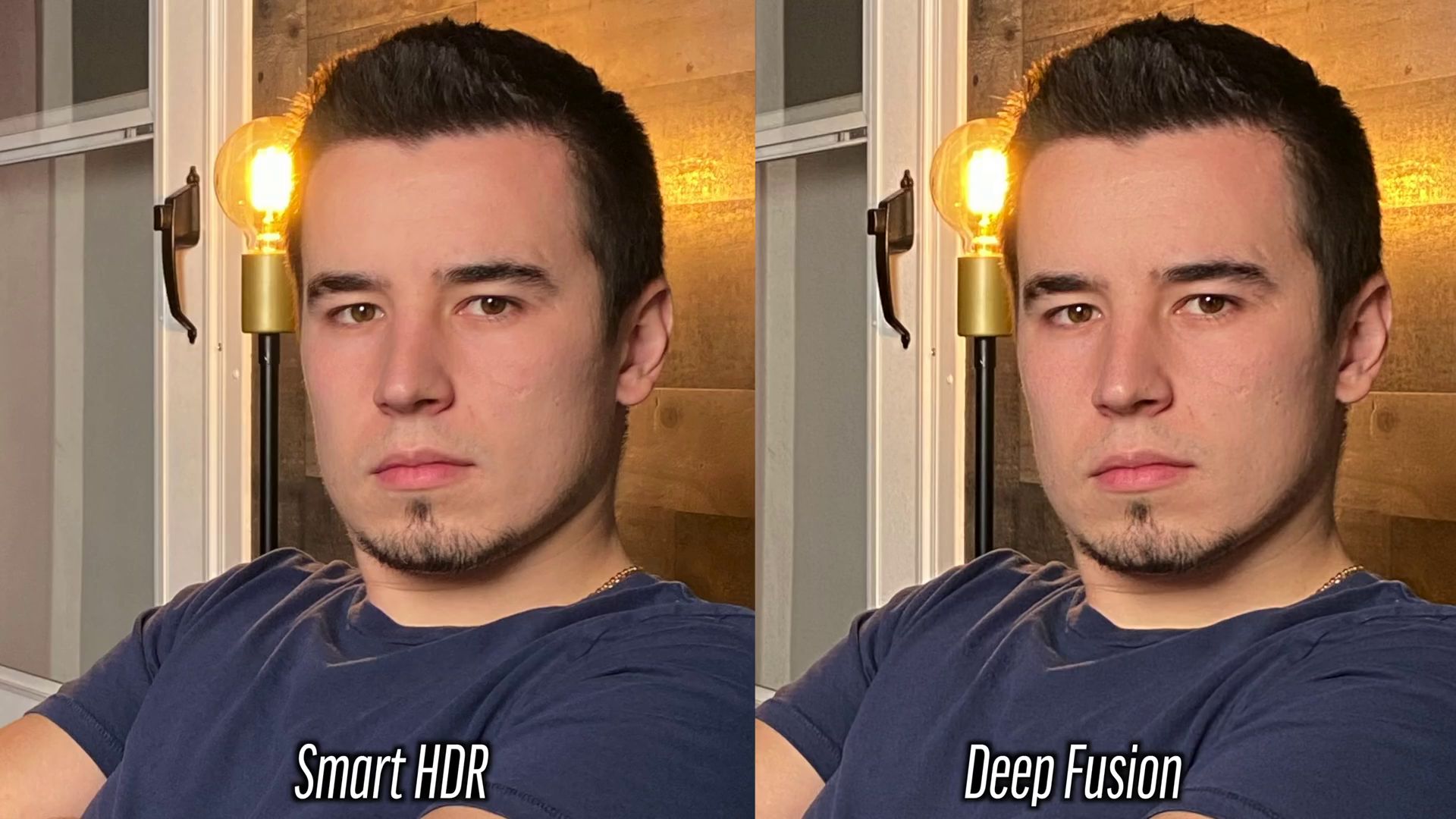

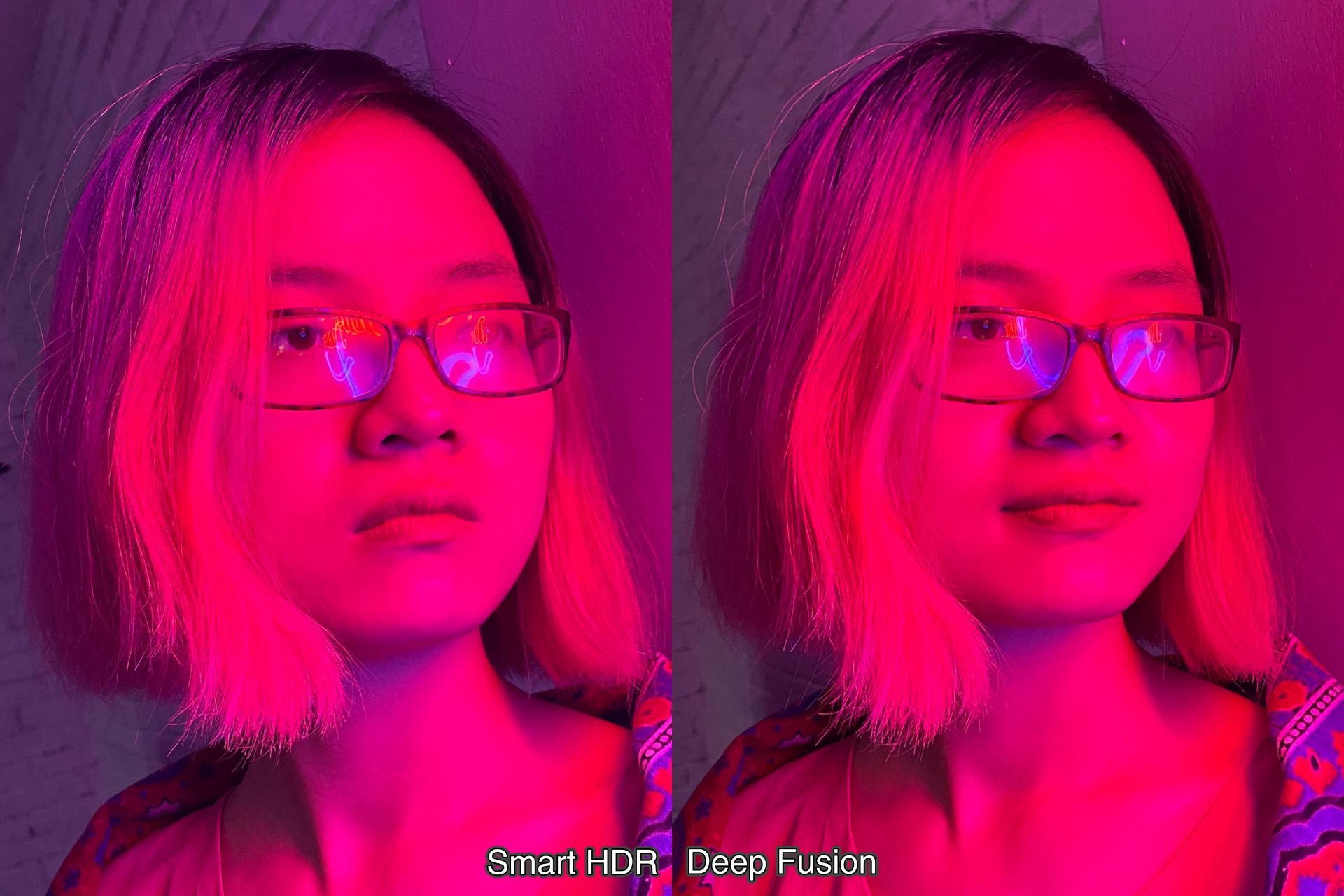

آنچه خواندید، توضیحات فیل شیلر در رویداد سال گذشتهی اپل بود؛ اما نسل بعد این تکنولوژی (Next-Gen Smart HDR) که در رویداد امسال بهصورت گذرا معرفی شد، از قطعهبندی معنایی تصاویر بهمنظور تنظیم هوشمند روشنایی نواحی مختلف سوژه بهره میگیرد. در نسل جدید Smart HDR، در صورت تشخیص سوژهی انسانی در صحنه، با نگاشت چندمقیاسی تونهای رنگ (Multi Scale Tone Mapping)، تنظیمات روشنایی متفاوتی به پیکسلهای متعلق به هر کلاس اعمال میشود و مثلا میتوان چهرهای با جزئیات کاملا واضح را با پسزمینهی آسمان روشن ثبت کرد.

معرفی نسل جدید Smart HDR در رویداد سپتامبر امسال اپل

DEEP FUSION

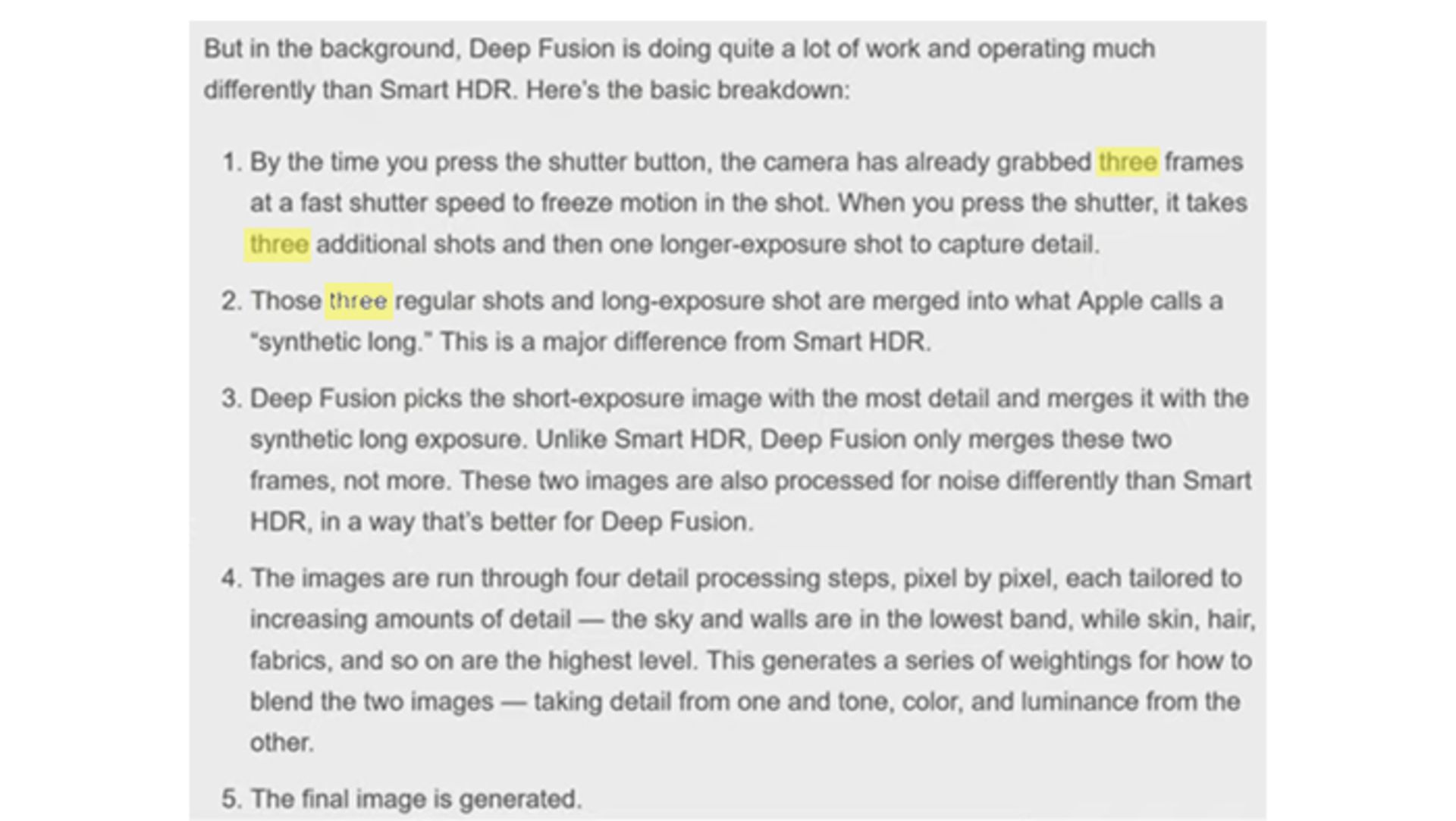

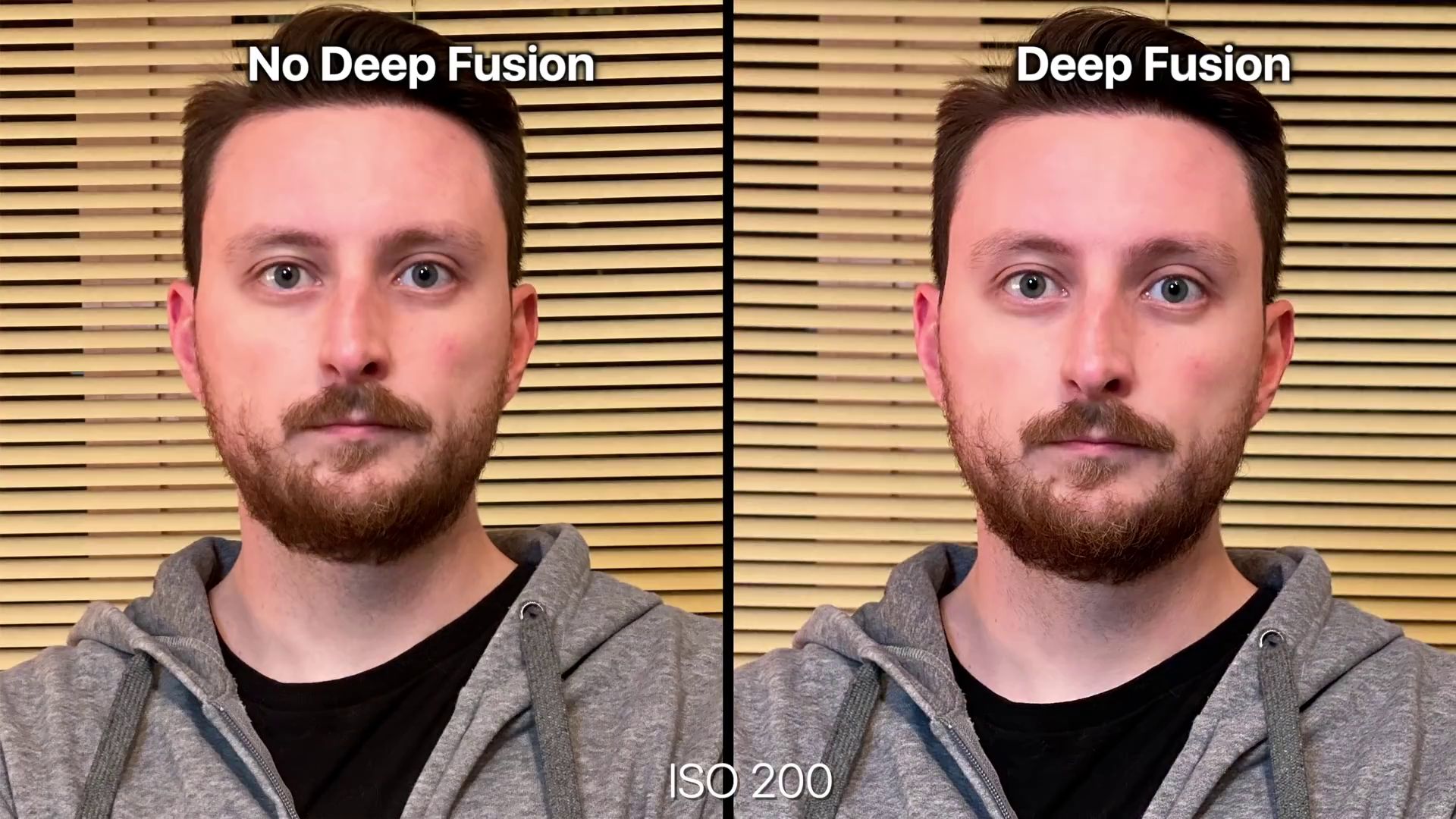

چنانکه میدانید، در حال حاضر قابلیت Deep Fusion در نسخههای بتای iOS 13.2 در دسترس است و احتمالا عکسهای ثبتشده در این مد را نیز دیدهاید. طبق ادعای شیلر، تکنولوژی دیپ فیوژن با بهرهگیری از موتور عصبی چیپِ بایونیک A13، یک سیستم پردازش تصویر کاملا جدید خلق میکند. در این مد پیش از فشردهشدن دکمهی شاتر، چهار تصویر با نوردهی کوتاه و چهار تصویر ثانویه ثبت میشوند (برخلاف معرفی Smart HDR، شیلر در اینجا اشارهی مستقیمی به ZSL نمیکند، احتمالا به این دلیل که چهار فریم ثانویه استاندارد هستند و نه شورت اکسپوژر) و پس از فشردهشدن شاتر نیز، یک عکس با نوردهی طولانی ثبت میشود. پس از آن موتور عصبی چیپ بایونیک A13، در عرض تنها یک ثانیه تلفیق تصاویر با نوردهی کوتاه و تصویر با نوردهی طولانی را پیکسل به پیکسل آنالیز کرده و پیکسلهای تصویر نهایی را با هدف کاهش نویز و افزایش جزئیات از بین ۲۴ میلیون پیکسل موجود انتخاب میکند (باتوجه به اینکه دوربینهای آیفون ۱۲ مگاپیکسلی هستند، در اینجا پیکسلها از بین دو تصویر انتخاب میشوند که طبق گفتهی شیلر یکی شورت اکسپوژر و دیگری لانگ اکسپوژر است). شیلر در ادامه اضافه میکند، این اولینبار است که یک موتور عصبی وظیفهی تولید تصویر نهایی را بهعهده دارد. البته در رویداد امسال اپل، Deep Fusion صرفا در غالب «Sneak peek» (نگاه دزدکی) معرفی شد و نسخهی نهایی این تکنولوژی بنا است تا انتهای پاییز ( ۲۲ دسامبر ) امسال ارائه شود. در ادامه مراحل عملکرد گوشی در این مد را به قلم نیلای پتال از نظر میگذرانیم (مطالب ذکرشده در کروشه توضیحات نویسنده است).

نسخهی قبلی مقاله نیلای پتال که در آن به ۳ عکس شورت اکسپوژر و ۳ عکس عادی اشاره شده بود

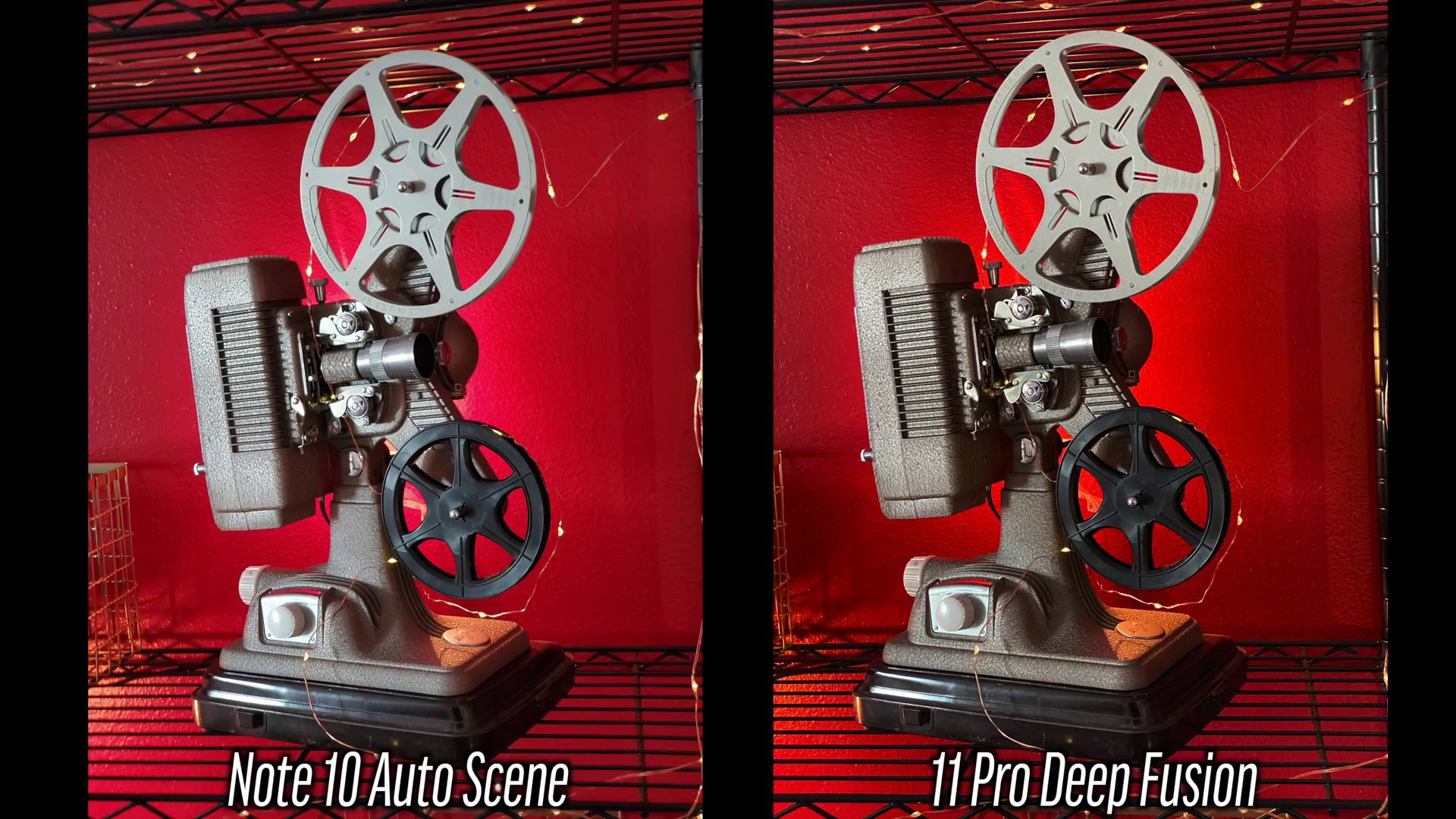

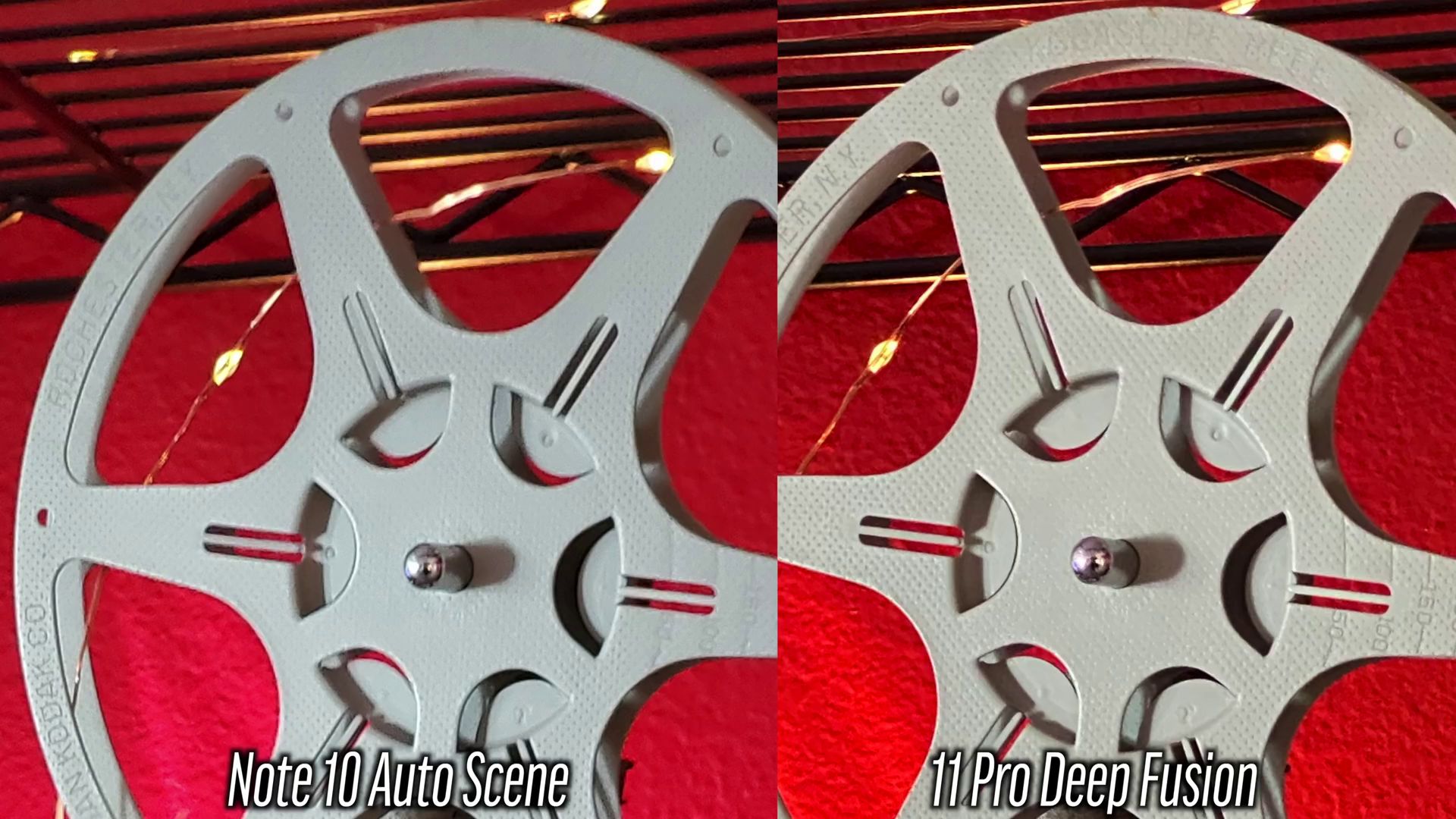

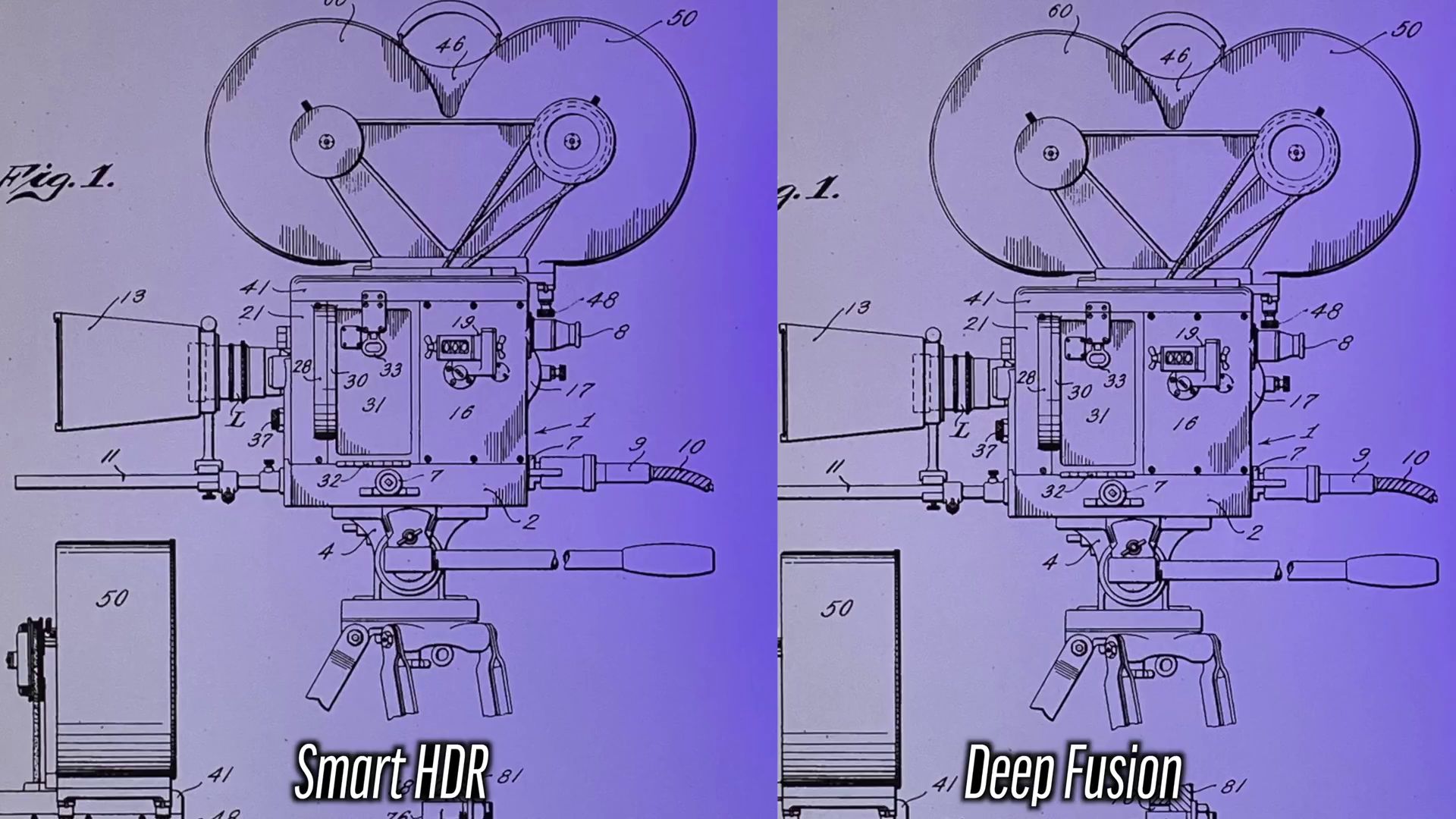

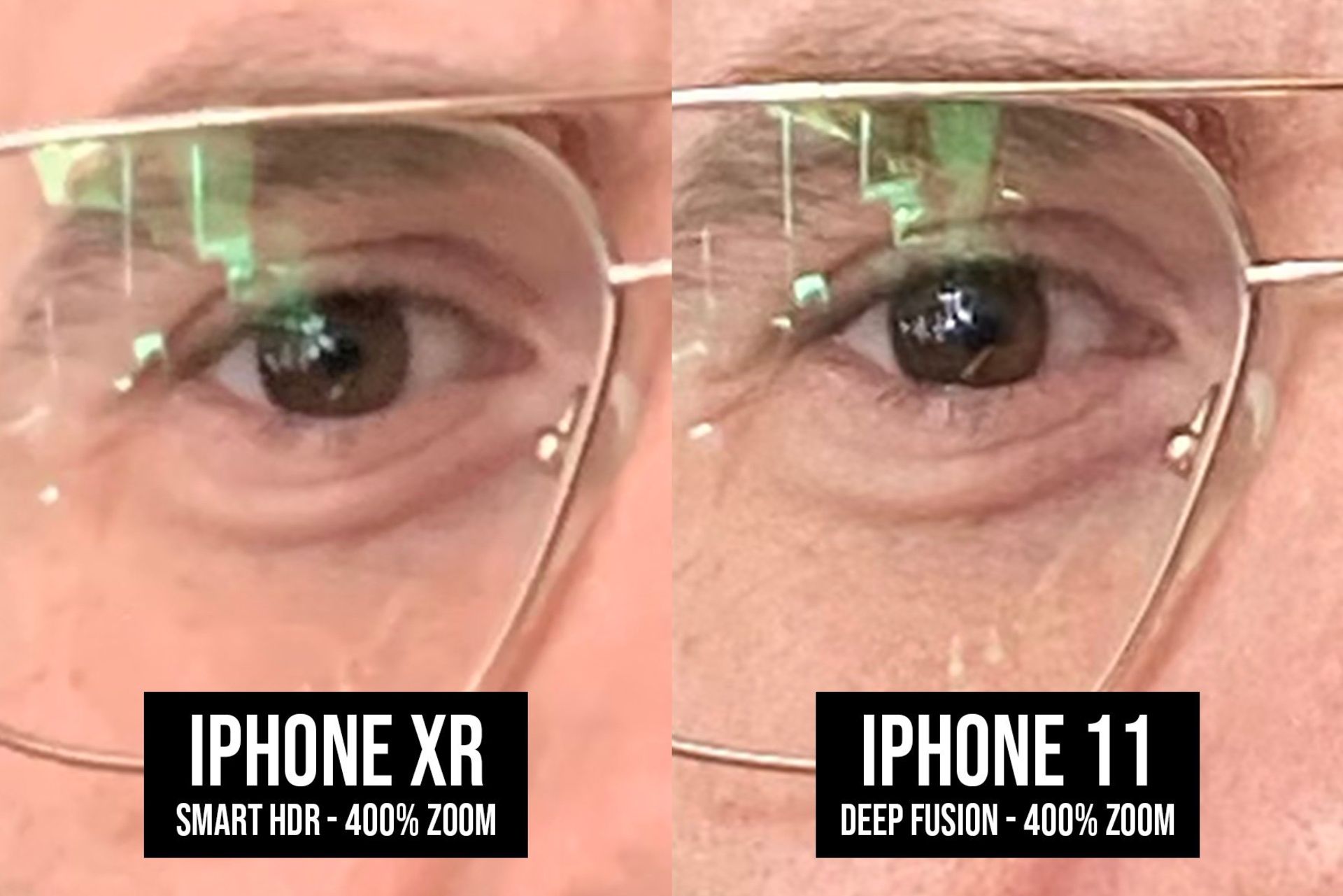

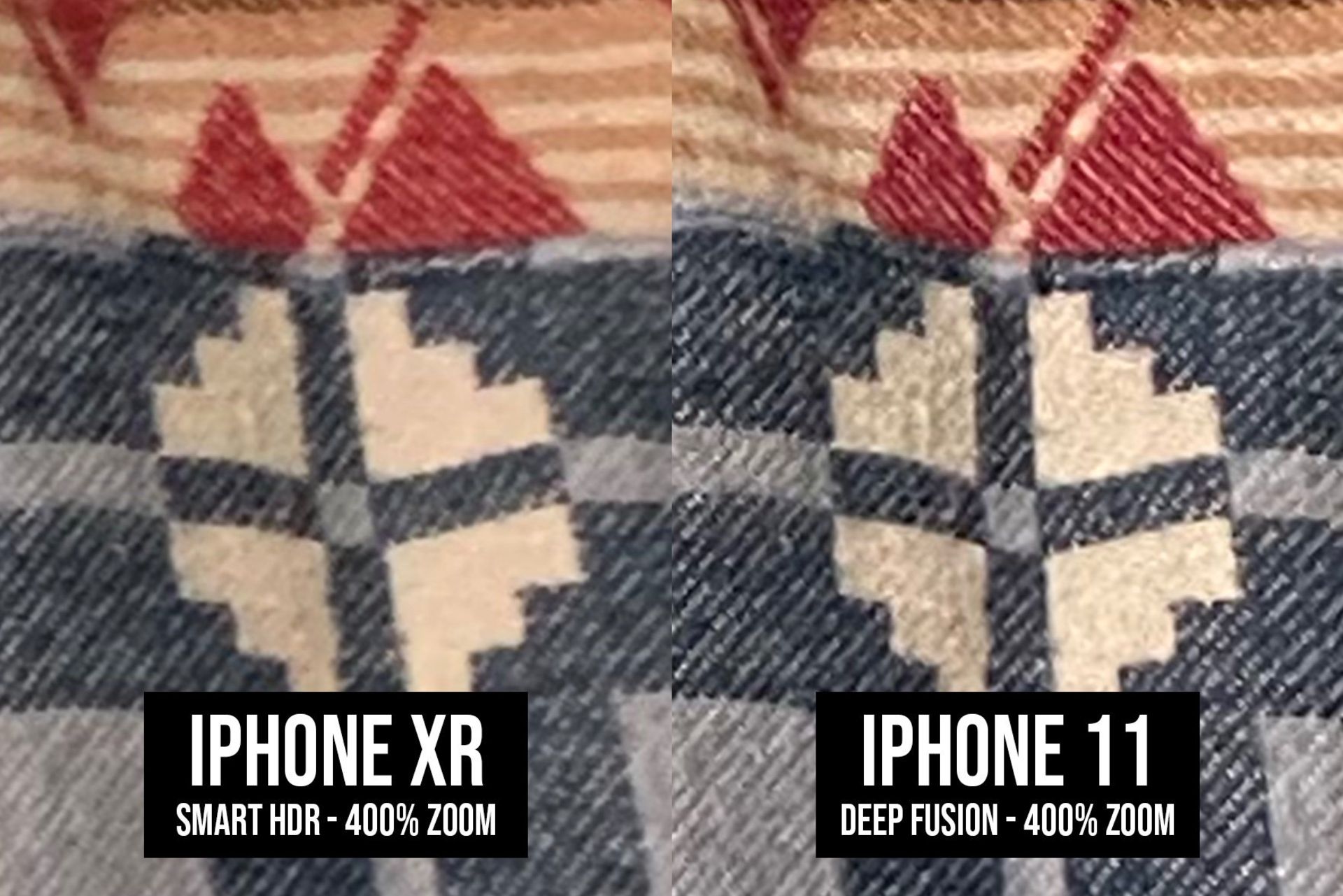

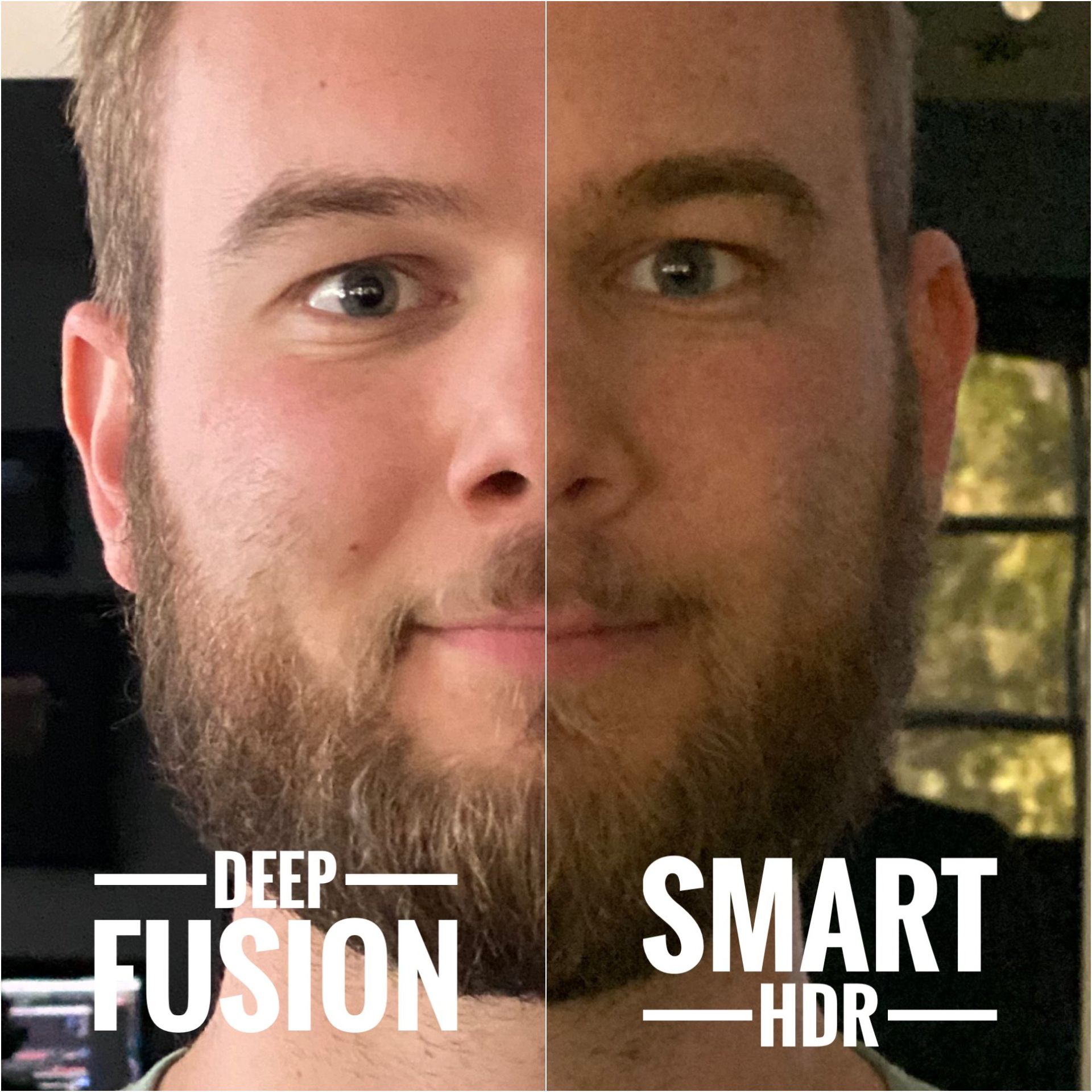

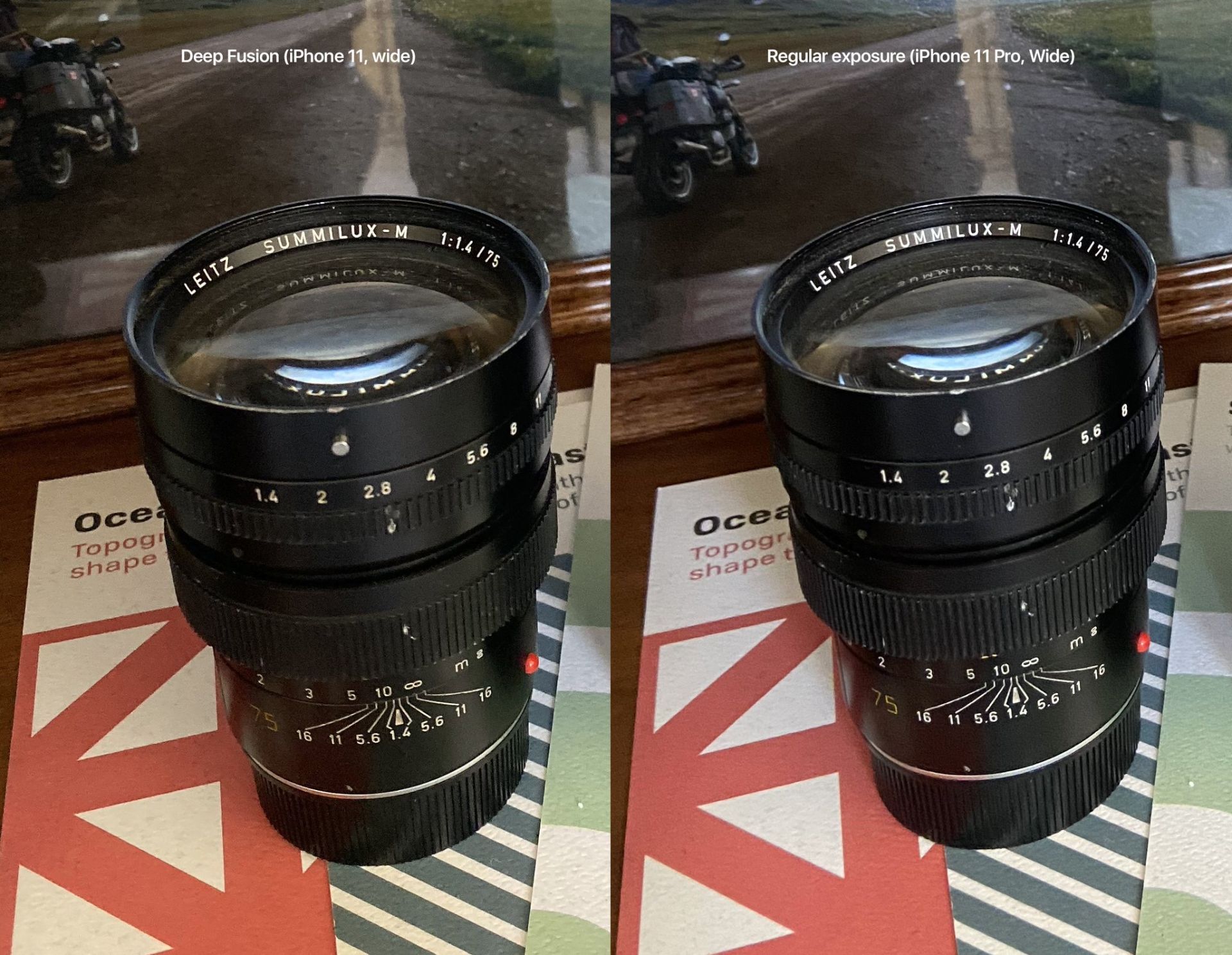

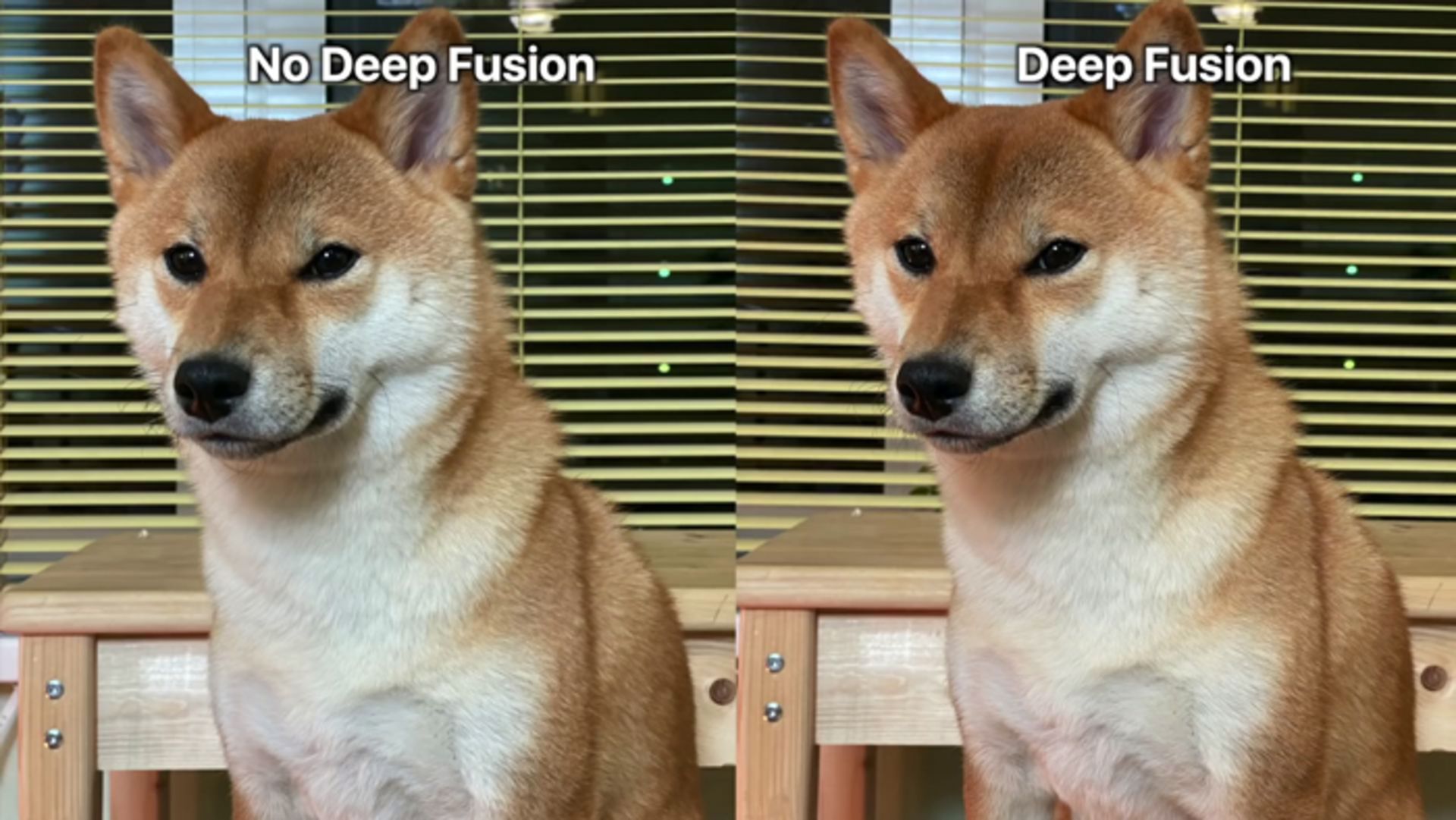

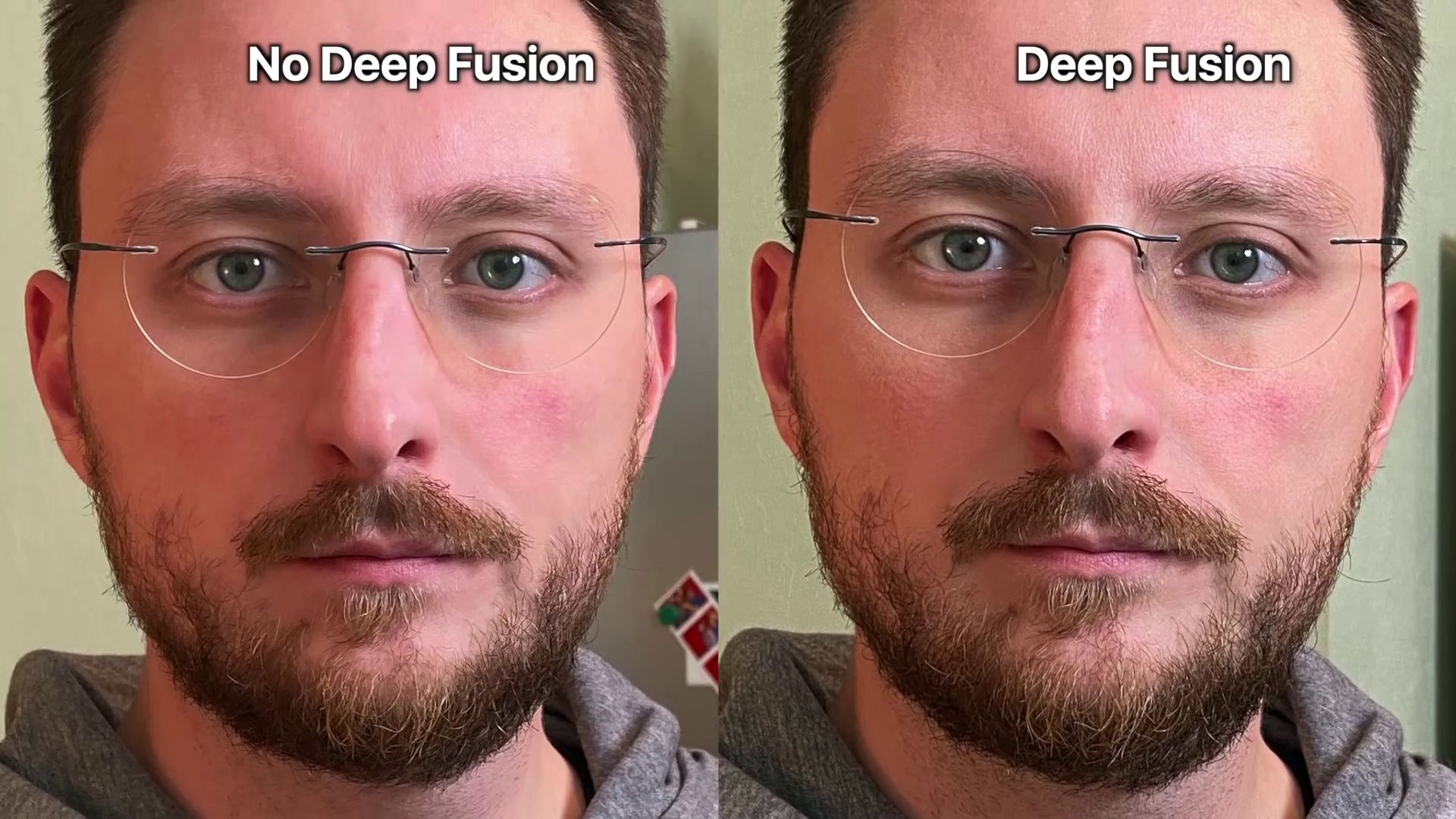

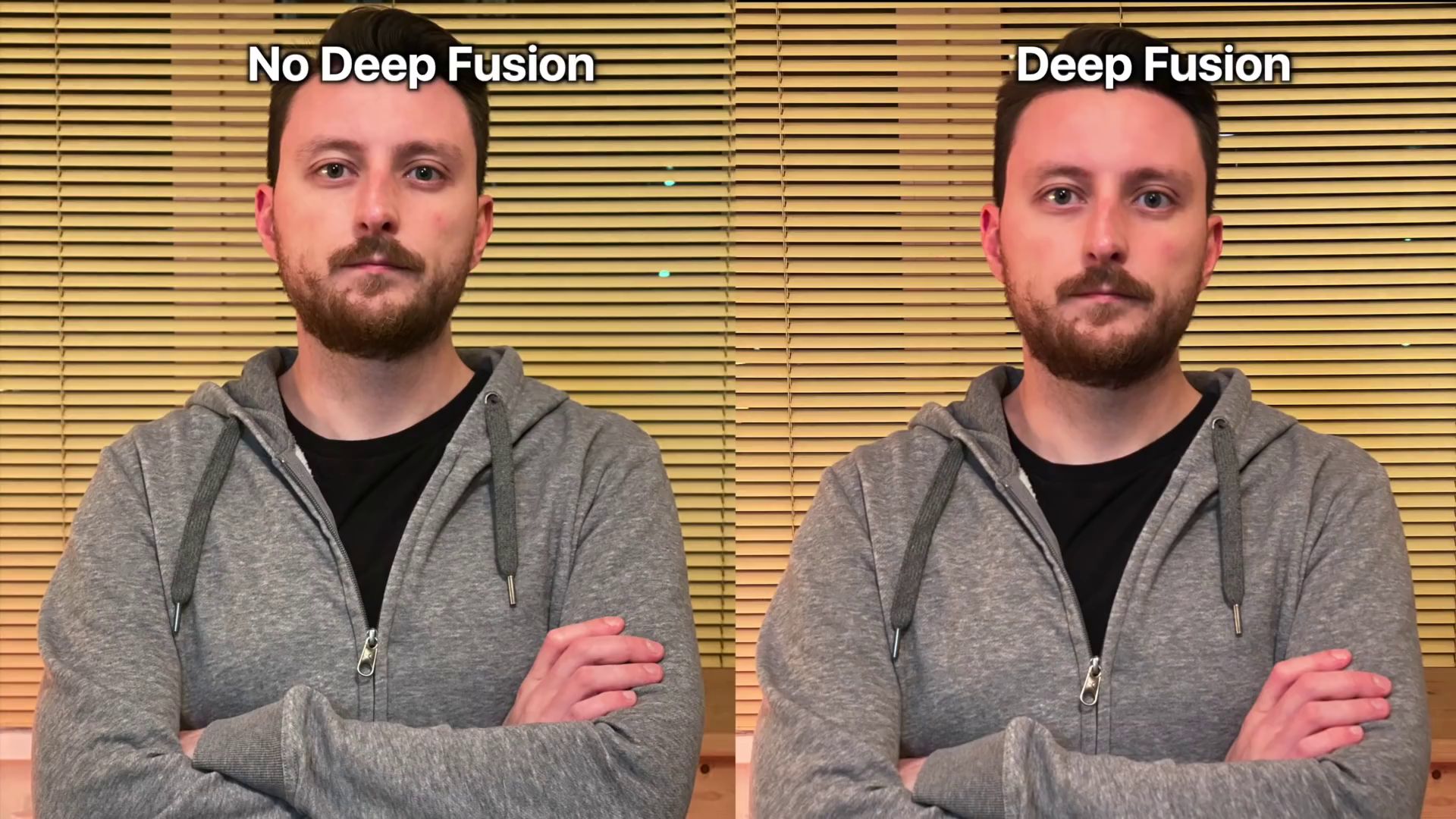

البته متیو پنزارینو، سردبیر تککرانچ، صحبت از چهار «شبکهی عصبی» مجزا کرده که دو تصویر ۱۲ مگاپیکسلی (داده ای محتوی ۲۴ مگاپیکسل اطلاعات تصویری) را برای تولید عکس نهایی پردازش میکنند. جالب اینجا است که تناقض در اطلاعات منابع مختلف به جزئیات محدود نمیشود و حتی در مورد تعداد عکسهای مورد استفاده در این تکنولوژی هم اتفاقنظر وجود ندارد؛ این درحالی است که فیل شیلر در رویداد اخیر بهوضوح اشاره کرد که در این تکنولوژی از ۴ عکس با نوردهی کوتاه، ۴ عکس ثانویه (کمکی یا فرعی) و یک عکس با نوردهی طولانی استفاده میشود. بههر حال طبیعتا وقتی صحبت از «عکاسی محاسباتی» به میان میآید، قدرت پردازشی چیپ و الگوریتمهای بهکاررفته، در کیفیت تصویر نهایی تعیینکنندهتر خواهند بود تا تعداد عکس و نوردهی فریمهای مورد استفاده، و شاید تنها معیاری که در حال حاضر برای قضاوت در این خصوص در اختیار داریم، عکسهای ثبتشده در این مد باشند:

کلام آخر

اگر میخواهید خودتان عکس بگیرید، دوربین هست؛ اما اگر بهدنبال وسیلهای هستید که برایتان عکس بگیرد، آیفونهای اپل احتمالا یکی از بهترین و البته گرانترین گزینهها هستند.

اما گفته بودیم که عکاسی یعنی نقاشی با نور؛ پس تا نور هست عکس بگیریم.

«همیشه نور هست»

همیشه «با نور» نقاشی کنیم.

چه زیبا سروده بود پل مککارتنی و چه زیباتر خواند.

آخرین بهروزرسانی: ۷ آبان ۹۸، ساعت ۶:۱۵ بامداد:

ساعاتی پیش از انتشار این مقاله در زومیت، نسخهی اصلی iOS 13.2 بهطور رسمی عرضه شد؛ در یادداشت انتشار این نسخه، درخصوص دیپ فیوژن میخوانیم:

iOS 13.2، دیپ فیوژن را ارائه میکند؛ سیستم پردازش تصویر پیشرفتهای که با بهکارگیری موتور عصبی چیپ بایونیک A13، در iPhone 11 Pro ، iPhone 11 و iPhone 11 Pro Max امکان ثبت تصاویری با جزئیات، بافت و کاهش نویز چشمگیر را در نور کم فراهم میآورد.

نظرات